Google携手MIT打造实时AI“修图师”

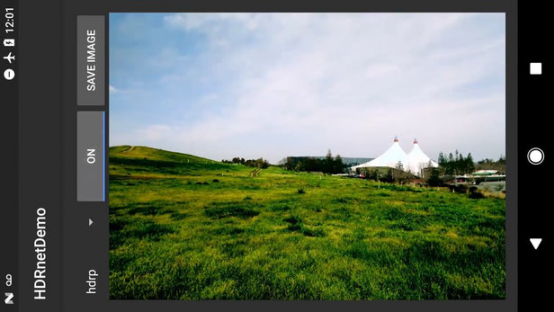

近日,MIT计算机科学与人工智能实验室和Google研究团队提出了一套系统,在不影响手机耗电量等性能的情况下,可以实时对照片细节进行修复,让拍照者立即得到HDR图像。

高动态范围(HDR),就是利用每个曝光时间相对应最佳细节的LDR图像来合成最终HDR图像,它能够更好地反映出真实环境中的视觉效果。

换言之,就是在拍照时,如果考虑高光区域的曝光,暗部细节就会丢失;而照顾暗部细节,高光区域就会过曝。为了解决这一问题,可以利用相机连拍至少三种曝光度以上的照片,最后再用软件合成一张保留所有细节的照片,此技术称为HDR技术。

据悉,早在16年的Google Pixel手机上,Google就开发了相关算法和软件,并显著改善了手机拍摄出的照片质量。其中,复杂高动态范围(HDR)算法是其技术核心,它可以捕获数字图像中颜色丢失的微小变化,但是受限于智能手机硬件的处理能力,而未能发挥很好的作用。

而早在2015年,MIT的研究生Michael Gharbi就开发了一个“转换器”,它可以很好地解决Google面对的问题,大大降低图像处理所需的带宽和功耗。

该“转换器”的具体实现就是,让手机向网络服务器发送图像的低分辨率版本,随后服务器发送回一个针对性的转换算法,将手机上低分辨率版本的图像修改为高分辨率的图像。“转换器”使得智能手机能在短时间内进行复杂的图像处理,且不耗费大量的电量。

据了解,最新的这套系统是Google在MIT的这款“转换器”之上,结合自己已有的系统开发出来的。

对此,Gharbi说:“Google听说了我做的工作,于是他们自己做了后续的工作,合并了两种方法。而现在我们要做的就是要让算法自己学习和选择,即融入AI,而无需人为向云端服务器发送图像。目前来看,第一个目标就是加速和优化程序,使其能在手机上运行。”

为了实现快速处理,团队开始从图像的低分辨率版本来进行处理,但因为高分辨率图像中的各个像素的颜色值变化微小,而机器学习系统必须从自身的“粗糙输出”辨识出图像各像素点的细微颜色变化特征,以判断出图像处理算法的类型,因此最大的难点依然是高分辨率采样的简单实现。

为此,该团队对机器学习系统进行大量的训练,在其输出设置上,团队没有让系统输出完整的图像,而是输出表示图像中像素点颜色修改程度的公式。在训练中,根据输出公式应用到原始图像后的效果与润饰后版本的近似程度,系统对机器学习性能进行判断,以此对其自身进行优化。

目前研究团队已对机器学习系统进行了5000张图像数据集的训练,其中每张图像都具有五个不同的润饰变体。

现在,在处理高分辨率图像上,融入AI的HDR算法比原始算法快了100倍,这也就意味着在很少的运存和电池电量的情况下,手机可以实时显示HDR算法修过的图像。

Google Research的Jon Barron表示,使用机器学习进行计算机摄影的改进是一项令人兴奋的想法,但一直受限于手机的处理器能力和电源容量。现在我们找到了避开这些问题的方法,并将会使用户有很棒的实时摄影体验。