刚用20天,ChatGPT致三星芯片机密泄漏

三星率先接入ChatGPT狂飙,但在20天内翻车了。

韩媒消息,三星电子引入ChatGPT不到20天,就曝出 3 起内部机密资料外泄事故。其中,2 起跟半导体设备有关,1 起跟会议内容有关。

目前,这些机密资料已被存入 ChatGPT 的数据库中,或将导致半导体设备测量资料、产品良率原封不动传输给了美国公司。

怎么出的事?

本次三星使用 ChatGPT 泄密事件共有 3 起,2 起与半导体设备有关,1 项与会议内容有关。

设计芯片设备的事件中,三星半导体事业暨装置解决方案(Device Solutions)部门的员工于操作半导体测试设备下载软件的过程中,发现复制有问题,即把有问题的代码复制到 ChatGPT 中寻找答案,此举有可能令 ChatGPT 把三星的机密信息当作训练资料使用。

另一事件同样发生在该部门,借助 ChatGPT 来优化代码,只不过此代码是涉及芯片良率的。三星 DS 部门于 3月 11日才允许员工使用 ChatGPT,不到 20 天时间便出现了意外。

第三起则是让 ChatGPT 记录会议内容,虽然不是技术机密,但仍可能导致会议内容外泄。

三星的反应

目前,三星正在制定相关保护措施杜绝类似事故再发生。综合 Economist、SBS 等韩媒消息,三星方面称,如遇类似事故,三星内部可能会切断 ChatGPT 服务。

如果切断一旦发生,三星“运算新事业组”所研发的“新一代超大型 AI 方向定制款存储器”这一明星项目也将被叫停,这对三星的损失是巨大的。

最初三星也因担忧内部机密外泄而禁用 ChatGPT,不过基于半导体是“生成式 AI”的建构基础,三星自2023年3月11日起放行 DS 部门使用 ChatGPT,但装置体验(Device eXperience;DX)部门仍禁用 ChatGPT。

三星在 ChatGPT 的使用指南中也特别呼吁职员注意 ChatGPT 的使用方式,并提醒使用者在 ChatGPT 输入内容后,相关资料都将传送到外部服务器无法回收。

三星 DS 部门放行 ChatGPT 不到20天,就出现内部机密资料外泄疑虑,证实先前部分观点的担忧,三星也在认知内部资料外泄风险后,紧急将每一个 ChatGPT提问容量限制在 1,024 byte 以下,日后不排除惩处。

信息泄露引发广泛忧虑

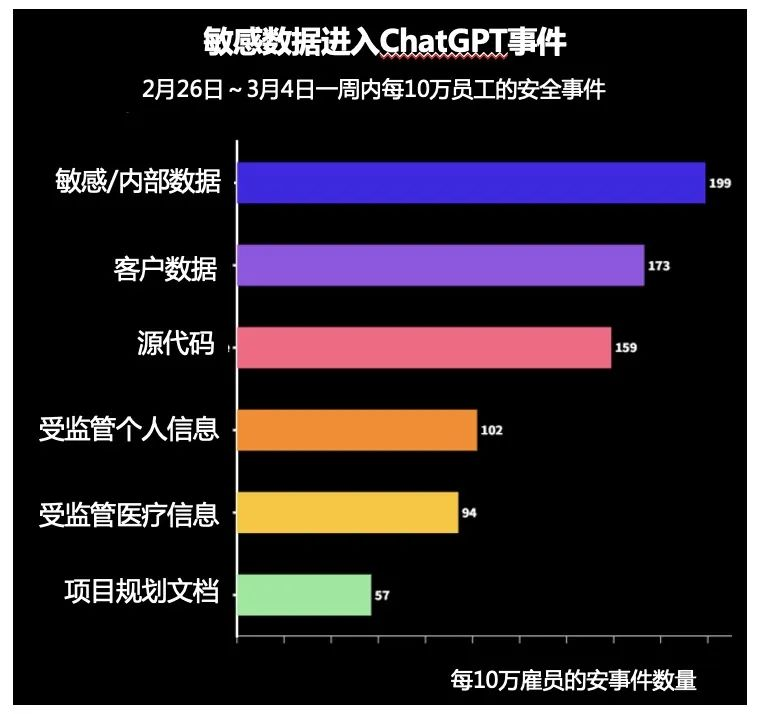

数据安全公司Cyberhaven的研究人员分析了不同行业客户的160 万员工的ChatGPT 使用情况——企业员工平均每周向 ChatGPT 泄露敏感数据达数百次,一周内约有 10万名员工的机构,向基于 AI 的聊天机器人提供机密文件199 次、客户数据173 次,以及源代码159 次。

一周内每10万雇员出现信息安全事件的类别情况,来源:Cyberhaven

随着更多服务通过API 集成ChatGPT技术,在未来几个月内信息安全事件可能会迅速增加。

出于对机密数据泄露的忧虑,美国银行、花旗集团、德意志银行、高盛集团、富国银行、摩根大通和 Verizon 等越来越多的机构禁止员工使用 ChatGPT 聊天机器人处理工作任务。

许多日本大公司也限制了ChatGPT 和类似聊天机器人的商业用途。该名单包括软银、富士通、瑞穗金融集团、三菱日联银行、三井住友银行等。

三星被爆信息泄露第二天,意大利国家数据保护局宣布全国范围内禁用 ChatGPT。缘因对 OpenAI 公司的调查中出现了“数据泄露”“非法收集用户信息”等危险行为。

可见,技术带来的数据安全隐患,包括数据获取、隐私泄露、恶意滥用、跨境合规等等,正在不断引发各方重视。

- END -