AI研究的盲点:无解的神经网络内在逻辑

伴随着大数据,AI在沉寂了多年之后,又迎来了新的高潮。在这场涉及大部分科学的革命中,人工神经网络释放了人工智能。但科学家们发现,这一关键技术暗含着一个问题:人工神经网络就是一个“黑匣子”。

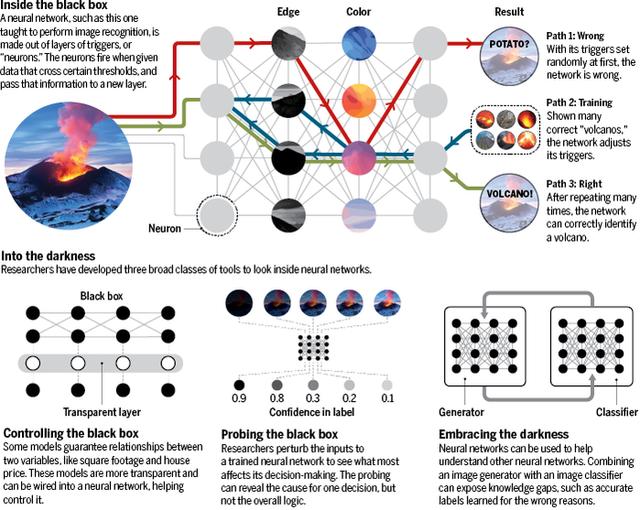

我们都知道,无论人工神经网络有多么复杂,都可以将其看作是三部分:输入层、输出层和隐含层。其中,我们通过深度学习,对神经网络进行一层一层的叠加训练,以此来有效调整神经网络各级神经元的权重。但是,这里有一个问题,除去输入和输出,我们对隐含层发生了什么一无所知,即对神经网络内部逻辑行为无从认知。

华盛顿大学的研究生Marco Ribeiro使用过一种叫做反事实探测的方法来了解这个“黑匣子”。此方法具体就是通过给输入一点微小的变化,随即查看输出的变化,并记录这些变化。但是很显然,这一方法需要上千次的操作和尝试,而且无法帮助我们全面认识人工神经网络。

而Google的另一位计算机科学家Mukund Sundararajan设计了一种探测器,大大减少了输入。不同于Ribeiro采取的随机输入,Sundararajan的研究创新点是引入一个空白的参考。

首先,Sundararajan输入一个零排列的数组,随后让输入数据逐步向需要测试的目标数据转变,以此通过输出变化来反过来研究内在逻辑。这里值得注意的是,随着每一步的变化,科学家们就能看到它确切的变化轨迹,从而可以以此预测变化特征。但这依然不可信,预测的结果仍然是存在很大误差的。

对此,美国华盛顿州微软研究所计算机科学家RiCh Caruana融入广义加法模型(GAM)来对数据间的复杂关系进行处理。我们都知道,统计学中GAM就是一种基于线性回归,然后在一组数据中找到线性趋势的方法。Caruana增加了这一过程,他先利用机器学习来输出变化,随后将网络输出的数据输入到GAM,找出变化之间的相关性,以此来研究神经网络的内在逻辑。

除此之外,在图像研究领域,还有科学家利用生成式对抗网络(GAN)对神经网络进行研究,然而所有的这些努力都是尝试,普适的研究方法至今尚未得出。

现在,不仅科学家认识到这一问题的紧迫性,多国政府也意识到这一问题。根据欧盟的一项指示,明年所有有巨大影响力的公司需向公众解释其模型的内在逻辑。此外,美国军方的蓝天研究机构国防高级研究计划署也正在向一个称为“可解释AI”的新计划投入7000万美元。

Google的机器学习研究员Maya Gupta说,硅谷的研究人员们也在试图打开AI的“黑匣子”。除了运行后操作的准确性,所有人心中还有一个非常大的顾忌:因为不知道它在做什么,所以不确定能不能相信它。

伴随着人工智能(AI)应用的蓬勃之势,出于安全隐患的考虑,神经网络内在逻辑的这一“盲点”确实急需规避。