迪士尼研究院用深度学习打造语音动画 让VR社交更真实

最近,迪士尼研究院联合东安格利亚大学、加利福尼亚理工大学和卡内基梅隆大学的研究人员,发布了一篇题为“A Deep Learning Approach for Generalized Speech Animation”的论文,阐述了通过深度学习来实现程序语音动画的方法。该方法采样完人们的录音后,即可自动生成与语音相匹配的口型动画。

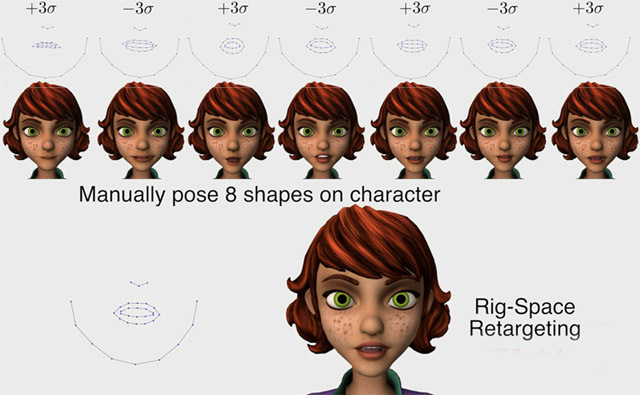

据了解,这是一个借助深度学习方法进行训练的系统,它能够分析来自任何扬声器的音频,学习从语音标签输入序列到口部运动的任意非线性映射,然后系统会自动生成相应的口形以及符合语音的面部模型。

如果应用到虚拟现实中,可以让虚拟的人物形象在说话的时候保持和现实中用户相同的口型变化,让VR社交应用的VR形象更加逼真。而且对于虚拟化身语音动画来说,虽然口型追踪是比较准确的方法,但是在这种口型追踪硬件普及之前,迪士尼研究院的程序语音动画是一个行之有效的好方式。

另外,在一些VR社交应用中也有通过系统实现语音动画的方式,主要也是基于音频来制作虚拟形象的口型动画,而基于深度学习的系统可以提供更高的准确性以及细节度。