错误的推理:人工智能也会受骗

人工智能大健康在智能识别的过程当中,即便是性能最为优越的AI也会因为系统缺陷而陷入迷局。著名学者、畅销书Us and them : The Science of Identity的作者大卫·贝雷比就表示,人工智能是可以被“欺骗”的,因为它们的内置推理机制都是呈模型化状态分布的。所以从这个角度来说,只要符合既定模型中的验证条件,一些原本不符合要求的样本也可能会被系统读取和识别。这就是说,在智能化推理的过程当中,人工智能也会出现“失误”,而如何将这些失误降到最低,就需要研究人员通过多种渠道来改善识别系统了。

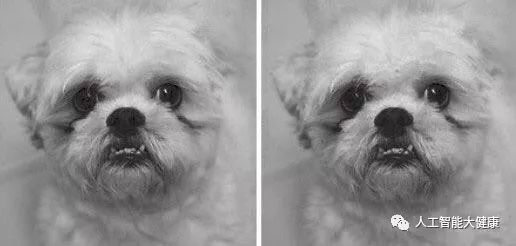

关于人工智能在推理方面的错误,一个由美国高等学府和社会科研机构组成的团队做了一个非常有趣的实验。工作人员先按照一定的标准开发出了一套可以识别图像文字的神经网络模型,然后他们将经过特殊化处理的图片录入到这个模型当中去,命令人工智能系统对该图片进行识别。如图所示,以人类的肉眼来看,这两张图片应该是不存在特征差异的。

但是对于这一套配备了特殊神经网络的人工智能来说,最终得到的结果却是令人大跌眼镜的:在本次测试当中,AI系统将左边的图片认定为“狗”,而右边的图像则被判定为“鸵鸟”。实际上,这两张图片之间仅仅是存在细微的像素差异,而镜像本体和所使用的拍摄器材,都是完全一致的。这就是说,在本次实验当中,图片像素的差异是误导人工智能进行错误推理的直接原因。

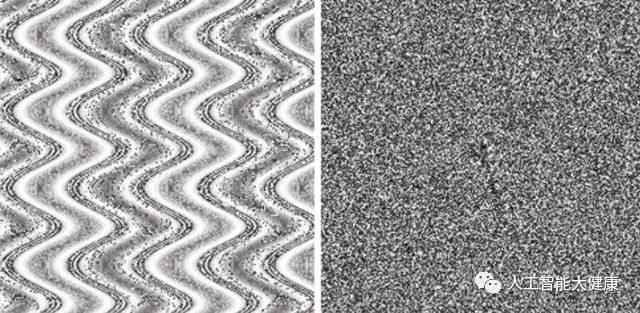

与此类似,美国怀俄明大学计算机系助理教授杰夫·克鲁联合另外两名研究者——阮昂和杰森·约辛斯基,共同论著了一篇关于人工智能的文章。在这篇名为“人工智能其实很好骗”的文章当中,克鲁举例表示,他们共同研发了一套用于识别图像的智能系统。当研究者将一张呈条状波浪形分布、主体为黄绿两种颜色的图片交给这套系统识别时,他们发现,这套识别系统用99.6%的确定性,将这张“毫无主题的水彩画”认作了“海星”;而在面对另一张布满杂乱混合斑点的图片时,该AI系统再一次犯错——它将图示当中的主体推论为“豹”,并对真实性做出了接近于100%的保证。

很显然,“小狗实验”和克鲁主导的图像识别实验,都向人们反映出了这样一个现象——人工智能在进行分析推理的过程当中,也会受到来自模型缺陷的干扰。比如在克鲁的实验当中,研究人员设定的识别模型,在样本定义上必然是存在不足的。对此,另一位人工智能学者、来自普林斯顿大学的索伦·巴洛卡斯就认为,克鲁的模型当中没有设定“生命”和“非生命”的限定,这就使得人工智能无法对一个样本进行有效区分。

图 克鲁实验:系统将左图识别为海星,右图识别为豹

巴洛卡斯解释说:“就以那张布满杂乱斑点的图像来说,假如克鲁团队关于识别模型的设定限定了‘很多斑点=豹’这一规则,那么当人们将这张图片录入到该模型当中时,这个识别系统就会因为从图片上检测出很多斑点,进而做出‘此图示为豹’的结论。”

可以看到,人工智能的逻辑推理是带有强烈的程式化意味的。由于既定模型的局限性,即便是性能最为优越的AI系统也会在判定时出现偏差。而在生活当中,这一种推理机制带来的缺陷,也很可能会为人们带来极大的不便或者其他隐患。比如说在反入侵智能识别系统当中,一些不怀好意的人就可以通过识别模型的漏洞,给自己伪装上适配于该模型的装置,然后就可以顺利通过智能机关的检验。所以说,如何利用规则,回避类似漏洞就成了研究者们需要重点关注的话题。

显然,在巴洛卡斯的话语当中,我们已经能剥离出部分解决人工智能因何被骗的诱导因素了。按照他的说法,AI系统之所以能针对未知事物进行判定推论,内置在这一系统中的神经网络起到了关键性作用。而一旦这个网络出现部分可被利用的漏洞,那么当有“非正确的适应性样本”进入检验阶段时,这个错误的样本就会被接受并解读出来。

比如说对于某一个神经识别网络,我们设定以下规则:

(1)穿红色衣服的学生每人得到1个苹果

(2)穿黄色衣服的学生每人得到2个苹果

(3)穿非红色衣服的学生不分配苹果

很显然,第三条规则的介入,对整个评判体系产生了错误的影响。对于1名穿黄色衣服的同学来说,如果按照第二条规则来执行分配,他就会得到2个苹果;如果按照第三条规则来界定,他就被排除在了分配原则之外。而在一个神经网络中,类似没有受到加权限制的规则,很可能会同时执行,那么使用这一种网络模型来分配苹果,必然会出现一部分黄衣服学生持2个苹果,另一部分黄衣服学生没有分到苹果的混乱现象。

所以说,在一个模型体系中,互相之间存在矛盾的因素,是会对这个模型带来极大的负面效果的。针对这种情况,其实只要再加上一条“假如规则之间发生冲突,以规则(1)为准”,这一切就迎刃而解了。

另外,在上述几条规则当中,同样也存在没有针对样本进行深入限定的问题。比如有1名穿红衣服的玩偶混杂在了待分配者中,那么AI系统也会按照既定条例,给这个玩偶发放1个苹果。那么针对这一漏洞,设计者需要做的其实和之前一样,那就是增设规则选项,将受分配者限定为“能够呼吸的人类”。

所以说,人工智能受到欺骗,实际上更多因素是受制于内置模型的缺陷。由于对样本规则的限定缺漏,人工智能在推理的过程中也会受到各种误导。由于识别系统的模式化,AI系统对于样本的判定都是通过模型当中的设定点来寻求对应关系的,在这种条件下,部分不符合要求的结果,或许也能因为关键点的契合而顺利通过。如果要解决这一问题,设计者就需要研发出更为精准、验证节点更多,或者是研发出以“线性”“面性”,甚至是“立体性”的验证规则,而这就需要研究者进行更为深入的研究。