深度解读《人工智能的可解释性》

物联网风向人工智能对我们来说是非常重要的。

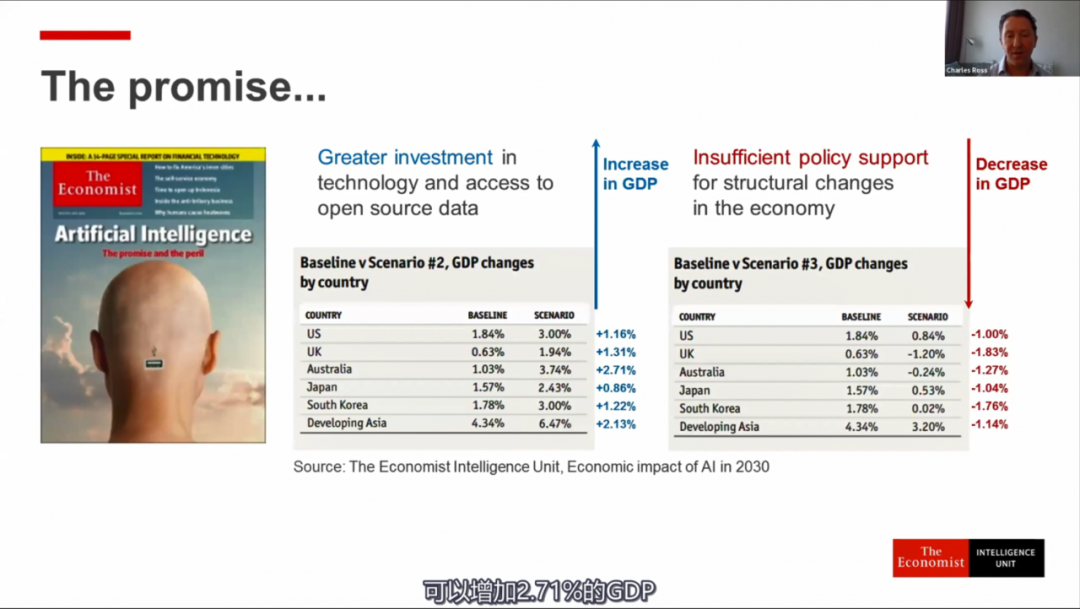

《经济学人》智库亚洲编辑部主任Charles Ross 用与谷歌合作的一个调查数据告诉我们人工智能对于每个国家所带来的影响,左边这幅图,显示的是如果国家能够持续对人工智能产业采取比较积极投资和政策支持,2030年这些国家的GDP将得到显著的更进一步的提升。而增长最快的是澳大利亚,可以增加2.71%的GDP,反之则带来非常不利的影响。

但随着AI研究与应用不断取得突破性进展,高性能的复杂算法、模型及系统普遍却缺乏决策逻辑的透明度和结果的可解释性,导致在涉及需要做出关键决策判断的国防、金融、医疗、法律、网安等领域中,或要求决策合规的应用中,AI技术及系统难以大范围应用。而XAI(eXplainable Artificial Intelligence)技术就是主要研究如何使得AI系统的行为对人类更透明、更易懂、更可信。

什么是人工智能的可解释性

主讲嘉宾:菲律宾联合银行人工智能和数据资深顾问 David Hardoon 博士以汽车的发展史为例,深入浅出地解释了人工智能的可解释性是一个什么概念。

它就好像在1914年拿到了一辆福特T型车,很多驾驶员可以解释他大部份的工作原理,懂得如何自己修理。而现在当我们拿到了一辆特斯拉,我们可能不知道它的运作原理,只是知道这个启动按钮,踩一下这个油门,这辆车就开了。与长期的汽车演化历史相比,AI的出现和广泛的运用是如此的突然,而在如此短暂的时间里,我们作为使用者,无法完全了解这个产业链的相关信息,所以在可解释性的第一个层面,就是回答这个问题:谁了解这个技术以及它的产业链,谁为什么环节负责,如何负责。这将是我们建立信任的基础。

我们有三个方面的内容需要考虑:

01可解释性的前提——不同的应用场景和交流语境

02解释的对象是谁?他/她需要了解什么?

03政策和规范对人工智能的可解释性有什么标准?

可解释性,其实是人性的需求,也是建立互信的需要。理解这个底层需求,是非常非常重要的。我们不仅仅讨论的是可解释性,我们实际上是通过解释,通过让人了解,去建立彼此的互信。

1 2 3 下一页>