深兰科技|计算机视觉+艺术处理,现实场景秒变动漫大片

深兰科技

近日

在深兰科技的官方抖音上

发布了这样一个视频

这是利用人工智能技术,将电影《魔兽》中的片段转成了动漫的画面。本就科幻的剧情,在动漫场景下,不禁让人重回游戏,再次走入两个世界的种族为了各自的生存和家园奋起而战的故事……

深兰科学院的算法专家借助计算机视觉技术,基于机器学习和生成对抗网络(GAN),对图像进行了风格迁移处理,可将真实世界的图像直接转换为高品质动漫风格。由此,画师便可将节省下来的大量时间,用于更多富有创造性的工作,从而产生更大的价值。而经典老电影,也可以利用去燥、上色、转动画等一系列人工智能方法进行处理,来一次二次元的穿越,满足人们越来越多元化的视觉需求。

真实场景转动画

1.技术背景

漫画是在日常生活中我们能够广泛接触到的一种艺术形式。除了艺术本身之外,它的适用范围从出版媒体到儿童教育,和其他艺术形式一样,很多著名的漫画形象都是基于现实世界的场景创作的。图1-1展示了真实照片转换成漫画的效果。

图1-1人物变卡通

为什么要把真实场景转换成卡通呢?在现实工作中,使用卡通风格手绘重现现实世界的场景是一个费时费力的工作,而且需要很多专业的绘画技能。为了获得高质量的画面,原画作者必须仔细绘制每个线条,并对目标场景的每种颜色区域进行涂色。

目前看来,具有标准特征的现有艺术编辑软件和算法无法产生令人满意的漫画效果。因此,如果有专业技术能够自动将真实世界的照片转换为高品质的动漫风格画面,对于画师来说是非常有帮助的一件事:这可以为他们节省大量时间,让他们专注于更有意义和创造性的工作。

以艺术方式对图片进行处理的研究一直是计算机视觉的热门方向。此前的传统方式通常针对特定样式开发特定的算法。然而,这意味着需要做出大量技术上的努力才能做出模仿个人艺术家的细致风格。而基于机器学习的风格迁移方法,可以通过示例图片对图像进行风格化,已经引起了很多人的关注。特别是生成对抗网络(GAN)引入了循环方式训练,进一步探索并提高了风格迁移的质量,GAN的独特之处在于可以使用不成对照片和风格化图像进行训练。

尽管基于学习的风格迁移已经有了很多成果,但最好的风格迁移方法仍无法生产具有可接受质量的漫画风格图像。

究其原因:

首先,漫画风不是添加纹理和边界线,而是需要从现实世界图像的复杂构造中高度简化;

其次,尽管艺术家之间风格各异,但卡通图像具有一些明显共通之处:边缘清晰、颜色遮罩平滑、质地相对简单——这与其他形式的艺术作品截然不同。

这次我们要介绍的技术是清华大学提出CartoonGAN,一个基于GAN的全新照片漫画化方法。该方法需要一组照片和一组漫画图像进行训练。为了让训练数据易于获得,同时获得高质量的结果,我们不需要让两组图像互相配对或对应。从计算机视觉算法的角度来看,漫画风格化的目标是将照片流型映射到漫画流型中,同时确保其中的内容不变。

2.技术细节

2.1 网络结构

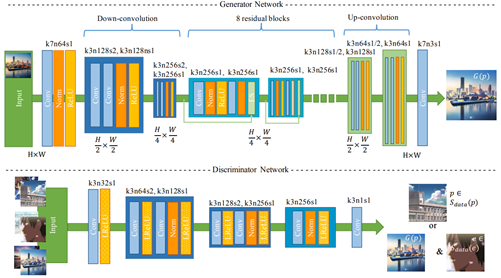

CartoonGAN作者提出了一个专用的GAN网络架构,包括生成网络G和判别网络D,都比较直观基础,如图2-1所示:

图2-1CartoonGAN的生成器(上)/判别器(下)的网络结构

生成器网络

生成器网络G用于将输入图像映射到漫画流型中。在模型经过训练后,漫画风格化任务就可以执行了。如图2-1所示,G从平卷积阶段开始,随后是两个下采样卷积模块,以对图像进行空间压缩和编码。随后使用相同布局的八个残差区块来构建内容和流形特征。最后,通过两个上卷积模块重构输出的漫画风格图像。

判别器网络

为了与生成器网络形成互补,判别器网络D用于判断输入图像是否是「真实的」漫画图。由于判断图像是否为漫画是个要求不高的任务,因此使用D中参数较少的简单判别器。与图像分类任务不同,漫画风格鉴别任务依赖于图像的局部特征,所以判别器网络D被设计得较浅。如图2-1所示,在平层之后,网络采用两个步长的卷积块来降低分辨率并编码用于分类的基本局部特征。随后,使用特征构造块和3×3卷积层来获得分类返回。

1 2 3 下一页>