解码商汤大模型体系

数智前线

不久前,商汤科技展示了旗下的多个大模型。与其他家有所不同的是,商汤的大模型体系可以以视觉为核心,结合语言及各种模态的数据,形成多模态的应用支持能力。

这样的技术路线可以保证模型从百亿参数到千亿参数到后面万亿参数,每一步都能用在实际行业和产品里,形成用户反馈闭环,有利于下一步的模型迭代。

文|赵艳秋 徐鑫

编|周路平

ChatGPT掀起的大模型热潮,让国内大模型的训练进入白热化阶段。

4月10日,商汤科技在上海临港智算中心举办的技术交流日上,公布了大模型体系“日日新SenseNova”。该名称取自《礼记·大学》“苟日新、日日新、又日新”,商汤科技董事长徐立调侃称,之所以叫日日新,是因为“苟日新”不好听。而这一名字是希望在模型迭代速度及处理问题的能力上可以日日更新,不断解锁AGI更多可能。

商汤并未公布大模型采用的技术路线,但商汤科技联合创始人、大装置事业群副总裁陈宇恒透露,人类生活中至少有80%的信息来自于视觉,凭借商汤在视觉领域的积累,加入语言、代码等不同信息做深度的融合,可以训练出更好的多模态大模型。这与百度、阿里等有所不同。目前,业界大厂都在不同技术路线上摸索大模型技术,追赶OpenAI。

01

商汤大模型,从视觉走向AGI

尽管临港位置较偏,但挡不住人们对大模型的关注热情。现场挤满了来自全国各地的合作伙伴,他们也在寻找新的技术范式能与自身业务的结合点。

商汤当天展示了“日日新SenseNova”大模型体系下的语言大模型,还展示了AI文生图创作、2D/3D数字人生成、大场景/小物体生成等生成式AI模型及应用,在领域模型之上,结合各个行业的数据形成行业落地的闭环。

相比于国内外大模型,陈宇恒告诉数智前线,视觉感知是商汤的优势之一。目前,商汤已研发了320亿参数量的全球最大通用视觉模型,实现了目标检测、图像分割和多物体识别算法。早在2019年,商汤已推出10亿参数量规模的视觉模型,在2021年~2022年,商汤训练了百亿参数规模的超大视觉模型,相当于千亿参数语言模型的训练量。

目前,视觉大模型在多个领域落地应用。例如,在智能驾驶领域,商汤实现了BEV环视感知,做到了3000类物体的高精度识别,还构建了感知决策一体化的自动驾驶多模态大模型,带来更强的环境、行为、动机解码能力。

就在商汤公布大模型之前的几天,美国Meta公司发布了首个图像分割的基础大模型SAM,它通过自然语言的输入,去完成物体的分割。陈宇恒称,相关技术能力商汤已经具备,商汤视觉大模型在很多测试集上完成领先测试。相比美国的视觉大模型,陈宇恒认为,商汤的优势点在于,国内的应用场景广阔,结合其在城市、自动驾驶、商业元宇宙等领域的行业积累,形成应用闭环。

在基础大模型之上,商汤当天公布自研中文语言大模型“商量SenseChat”,是一个类ChatGPT应用,其参数量达千亿。数智前线获悉,在ChatGPT之前,商汤在NLP技术上已有数年积累,并早在2021年就应用在商汤的数字人等产品中,实现语音、NLP和视觉的全方位自研。

虽然大众关注大模型的“对话互动能力”,但业界更关注其背后的“理解推理水平”,这也是体现大模型能力的关键。徐立在现场着重展示了“商量”对长文本的理解和归纳能力。在徐立输入了《专利法》的PDF文件后,系统快速阅读理解《专利法》,并根据用户针对此文输入的问题,给出相应的答案。从结果来看,大模型并没有直接从《专利法》中复制对应的结果,而是在理解问题之后,生成总结性答案,也可以对比最新的专利法,给出前后做了哪些修改。

在人工智能内容生成方面,基于日日新大模型,商汤也推出了一系列生成式AI模型及应用,涵盖图片生成、数字人视频生成、3D内容生成等。商汤对这些模型的应用场景也进行了一一展示。

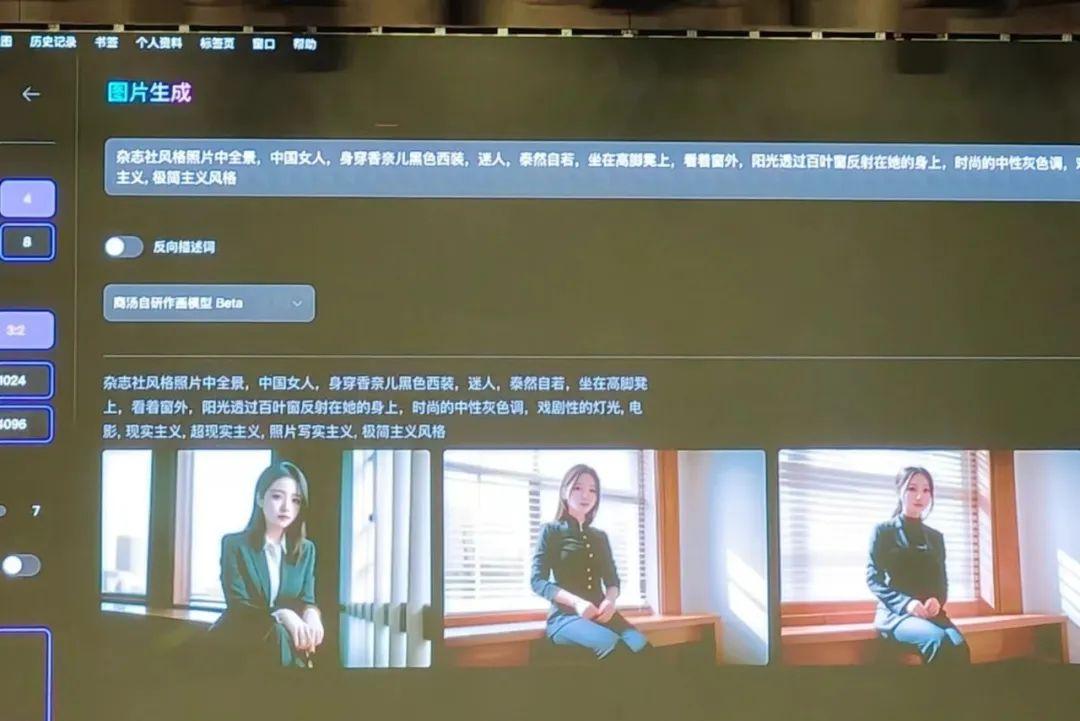

比如徐立现场演示了文生图平台“秒画SenseMirage”,他先后输入了“站在窗边的中国女性”,“站在窗边的穿汉服的中国女性”等关键字,起初表现效果都很好,之后输入了“80年代港风”作为关键字,但是生成的图片并没有显著的港风效果,这说明大模型对于该垂类风格的学习强度不及预期;但随后他将准备好的20张经典港风图片“投喂”给大模型,以商汤自研作画模型作为基模型来训练定制化LoRA模型,在几分钟后就生成了一个表达港风效果较好的LoRA模型。这种根据小批量样本快速适配新风格的学习能力也是商汤自研作画大模型的一个显著优点。

陈宇恒透露,之所以做多个大模型,主要是可以以视觉为核心,结合语言及各种模态的数据,形成多行业应用的方案。同时,这样的技术路线相对更平滑,可以保证模型从百亿参数到千亿参数到后面万亿参数,每一步都能用在实际行业和产品里,形成用户反馈闭环,有利于下一步的模型迭代。

从大的方向上,未来商汤要去挑战更大的模型,不断去接近通用人工智能。

02

构建用户与大模型的飞轮

在公布大模型的同时,商汤也介绍了其行业应用目标和情况。这是国内企业的特色。他们需要第一时间考虑产业落地问题。

而要“炼”出真正有价值的大模型,则需要建立用户与模型反馈的闭环。这是业界从OpenAI得到的启示。OpenAI在做出几版大模型后,建立起真实用户调用和模型迭代之间的飞轮。

数智前线获悉,商汤的大模型将更多服务B端客户,目前已落地20多个业务场景。

比如,在智能汽车领域,视觉大模型可以充当“半自动标注机器人”,对路测回游的数据进行过滤和预标注,让标注效率提高4 倍以上。商汤当天公布了自动化数据标注平台“明眸”,支持智能驾驶、智慧交通、智慧城市等多种场景的2D分类、检测和3D检测的智能标注。

大模型还可以解决智能驾驶过程中的Corner Case(边角案例)问题,也就是人们无法想到或不常见的事情。之前,传统小模型会像“狗熊掰棒子”一样,学了新的Corner Case,经常就“忘了”旧的,大模型能化解这个瓶颈,让其更可靠。而这两个问题也是目前自动驾驶迈向L3、 L4商用过程中的两大痛点。

再如,在生物医药科研领域,通过大模型,把蛋白质结构的预测时间缩短到1/60,从而大幅提高了抗体筛选的效率。

元宇宙也是大模型很好的应用场景。元宇宙是多种技术的结合体,像AR、VR、人工智能内容生成 、文本生成 3D 模型、文本生成视频等……大模型可以化解元宇宙内容制作成本过高的痛点。

而大模型的泛化能力,让原来很多长尾事件,变得可以解决。比如在智慧城市领域,大模型可以改善城市的各类运营的工作,如垃圾抛洒、粪车排放、单车违停等。

业界都认为大模型是一种新的技术范式,就像蒸汽机的出现,将能源转换效率提高了几十倍;电力的出现,又把能源转换效率再提升了几十倍。现在大模型可以把传统小模型的生产效率提升几十倍甚至上百倍,以非常低的成本服务于各行各业,为各行业的效率带来翻天覆地的变化。

商汤目前聚焦在智能汽车、智慧生活、智慧商业、智慧城市四大业务线的产品矩阵。要实现落地,还要同时思考如何构建产品体验,并以更高性价比的方式为客户提供。

陈宇恒告诉数智前线,商汤首先会提供整套工具链,让业界从基础大模型出发,或者基于开源大模型,进行微调,形成适合自己的模型。商汤有可能提供云上的隐私计算,帮助用户解决数据隐私的风险。

商汤还准备通过各种产品形态,包括私有化产品形态,提供给用户部署使用。

同时,商汤也会提供Model as a Service的API ,供用户低成本调用,还能通过知识蒸馏手段,把大模型的能力迁移到一些较小的模型上,满足一些成本敏感行业的诉求。

“从行业落地角度,我们可以训练一个超大模型,然后再外挂小一点的模型,类似lora或Hypernet技术,通过外挂小模型的微调和训练,把大模型的推理成本分摊下去。”他说。

03

两大难题如何突破

一口气展示多个大模型技术之后,外界很关心商汤在算力上的储备情况,以及高质量语料不足的情况下商汤如何应对。

数智前线获悉,在大模型的风刮起来之前,商汤已在规划AI大装置,2020年在临港建设了建筑面积接近20个足球场的AIDC,2022年正式投入使用。目前里面放置了5000个服务器机柜和27000块GPU,据说能同时满足20个类ChatGPT模型的训练。

业界广为流传是“万张GPU卡是进入大模型领域的入场券”。有业内人士表示,“标准大小的ChatGPT(参数1750亿)大概需要375-625台8卡A100服务器进行训练。如果愿意等1个月的话,150-200台8卡也是够的。每次训练总的GPU资源消耗量是35000卡天。”这个体量与商汤提到的训练大模型所需要的算力消耗规模在同一个数量级,当然该人士明确指出GPU类型是A100。

陈宇恒还谈到一个认知误区,算力的核心衡量指标并非单指显卡数量。他认为,训练人工智能大模型是“工程的奇迹”,有两大难题需要跨越:

其一是多卡并行状态下的有效利用率,即能够支撑大模型训练的实际算力,这涉及系统架构和网络架构设计。“1万张卡和1000张卡,理论上有10倍的训练速度提升,如果没有设计良好的系统架构设计,可能最终只有2倍的训练效率提升 ”。

其二是系统能够持续稳定运行的时长。如果每天每千张GPU有1张卡发生故障,当有1万张卡时,系统每天的稳定运行时间可能只有一两个小时,这是没法使用的。这要从硬件的可靠性和软件的容错能力角度去解决。

如何从几千张卡的集群,到未来上万张卡更大规模集群的部署,商汤正在努力建设优化中。目前,商汤的AI大装置已能够以最大4000卡规模集群进行单任务训练,并可做到七天以上不间断的稳定训练。

困扰业界的另一问题是,如何获取足够多的高质量数据语料。以GPT-3为例,它学习了约5000亿的语言数据量。而相比之下,人类的一生中可听到的大概是10亿个单词。所以,今天人工神经网络能够处理或者看的知识量,已经远远大于一个人一生中能学到的单词数。而今天已知最大语言模型消耗的数据量是2万亿个token。而据统计,人类文明产生的高质量语料数据一共是9万亿左右。因此,随着倍数往上走,很快就会面临着高质量语料被消化完的局面。数智前线了解到,巨头企业都正在寻求各类高质量的语料资源。

“研究表明,有超过80%的信息是通过肉眼获取的。”陈宇恒称,把整个互联网的文本数据汇集做适当的清洗之后,只有不到10个T的数据,但是像最大的图像公开数据集,它有50亿张图像,大小达到240T;视觉的信息量是文本信息量的非常多倍。“由此可以看到,以视觉大模型作为核心的技术突破点,去扩展到语言大模型等一些多模态的路线,是符合人类理解世界的基本逻辑,以及符合我们互联网生成数据的分布逻辑的。”

商汤在过往积累了大量的、有人反馈的、视觉类信息,这类信息作为知识输入到更大的网络当中,形成多模态输入,则打破了原有数据库的信息局限。商汤的语言大模型正是基于这一点快速发展,获取丰富的多模态语料数据。

此外,合理调配不同语言的语料比例,或者设计好数据经过模型的顺序和比例,包括设计不同领域知识的占比,再辅以不同语言的知识融合能力,也能使模型有更好的性能。

在未来,讨论大模型,讨论的将主要是模型的计算量。目前,除了上海的人工智能智算中心,商汤还在全国主要城市部署20多个超算集群。商汤强调,这些AI原生基础设施,为人工智能算法的训练、调度提供了敏捷、弹性、可靠的底座,也让商汤得以持续优化大模型建设,并赋能各个行业。

而随着越来越多的企业进入市场,大模型领域的竞争正在成为一场算力、算法和数据相结合的全方位战事。