8年增长1000倍,英伟达带来史上最成功的产品

赛博汽车

作者 | 章涟漪

编辑 | 章涟漪

“It’s ok,Hopper。You’re very good,good boy or good girl”。

北京时间3月19日凌晨,GTC最重磅的主题演讲开始,英伟达创始人黄仁勋身着标志性的皮衣,先是感谢了“改变世界的Hopper”,并宣布重磅推出新一代AI芯片架构Blackwell。

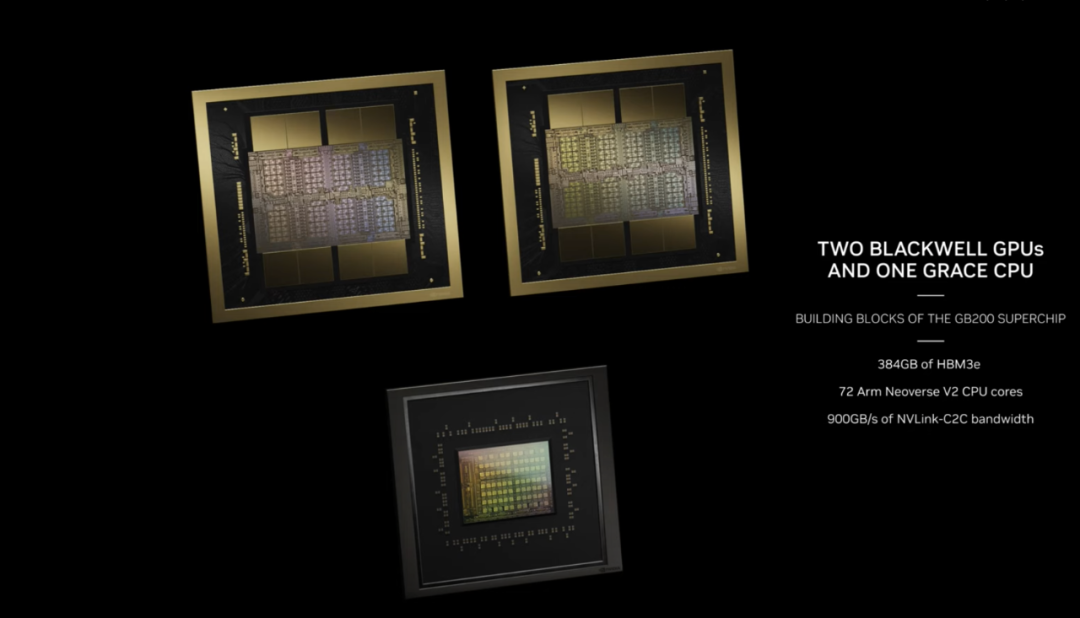

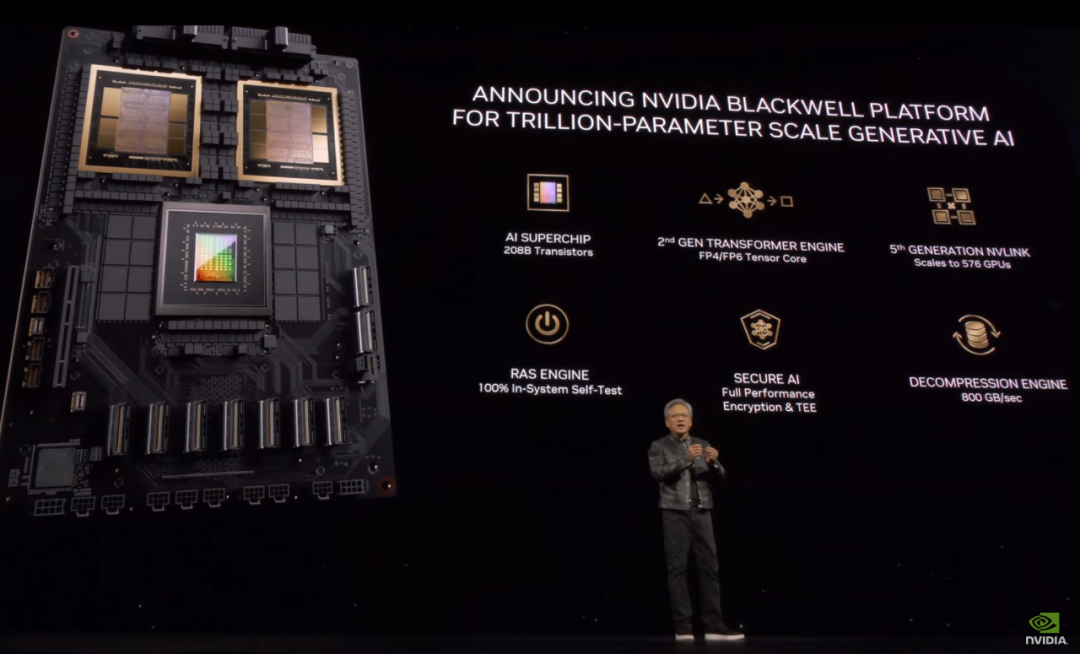

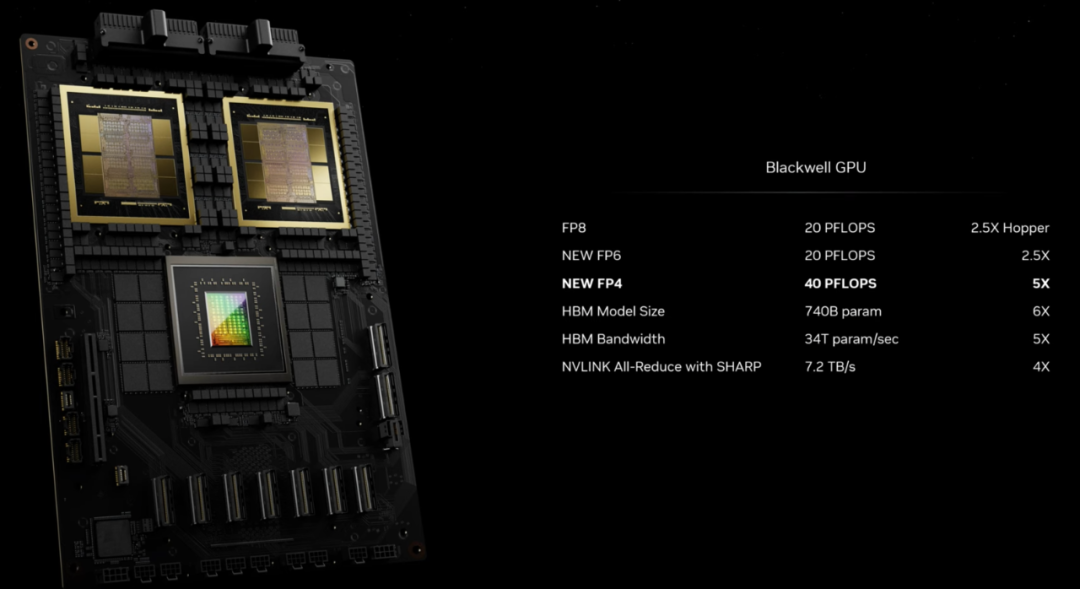

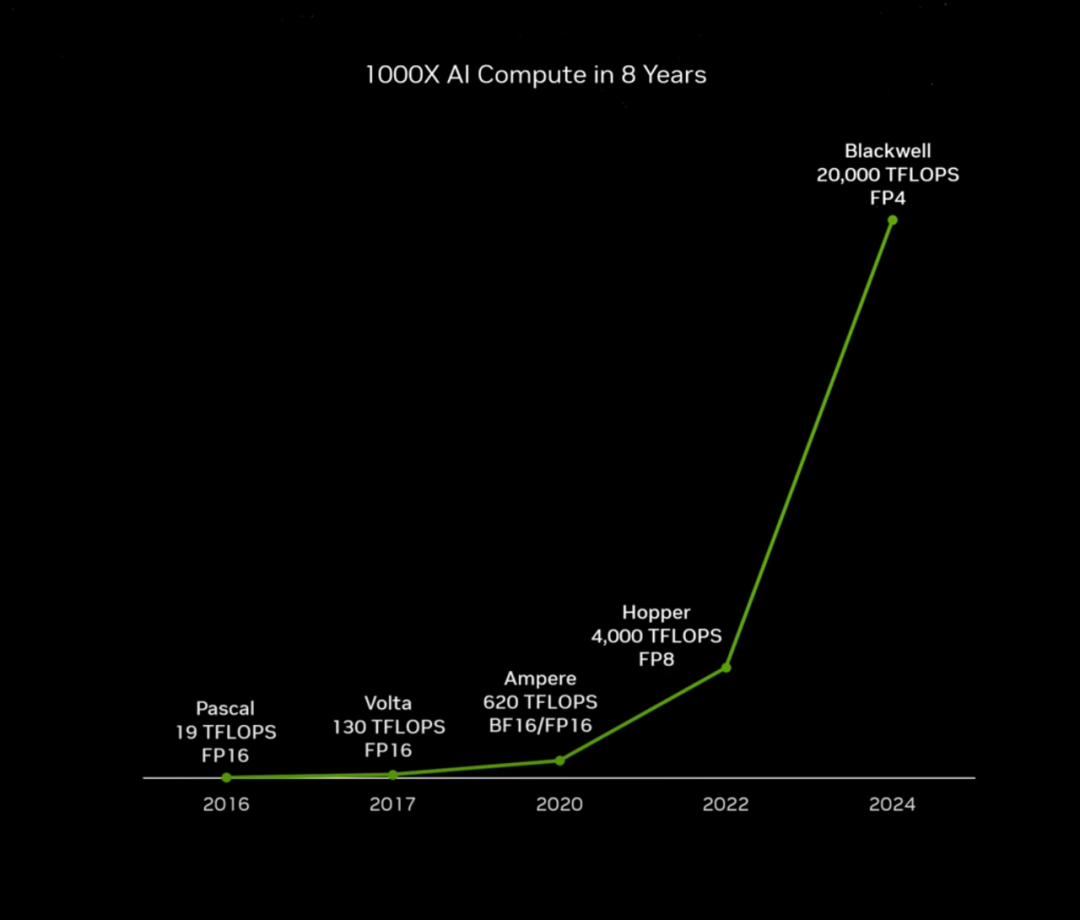

在他看来,加速计算已达转折点,通用计算已走到尽头,需要有另一种计算方式,来进一步降低计算成本、提高计算效率。"我们需要更大的GPU。"黄仁勋说。过去8年时间里,AI算力需求有了1000倍增长。在Blackwell架构下,芯片之间可连接构建出大型AI超算集群,支撑更大的计算需求。“它是英伟达最成功的产品”。黄仁勋进一步介绍表示,Blackwell拥有2080亿个晶体管,是上一代芯片“Hopper”800亿个晶体管的两倍多,可以支持多达10万亿个参数的AI模型。“其将成为亚马逊、微软、谷歌、甲骨文等全球最大数据中心运营商部署的新计算机和其他产品的基石”。

第一款采用Blackwell架构的芯片名为GB200。它被黄仁勋称为“史上最强AI芯片”,将于今年晚些时候上市。B200芯片拥有2080亿个晶体管,采用台积电定制的4NP工艺制造。值得一提的是,这次的芯片将两个die连接成一个统一的GPU,die之间的通信速度可以达到10TB/秒。黄仁勋强调,Blackwell架构的全新型GPU处理器设计架构在处理支持人工智能的大语言模型训练、推理方面速度提高数倍,而成本和能耗较前代改善巨大。他举例表示,如果要训练一个1.8万亿参数量的GPT模型,需要8000张Hopper GPU,消耗15兆瓦的电力,连续跑上90天。但如果使用GB200 Blackwell GPU,只需要2000张,同样跑90天只消耗四分之一的电力。不只是训练,生成Token的成本也会随之显著降低。016大创新技术,Blackwell被认为是“最成功产品”“1993年,英伟达旅程开始……”

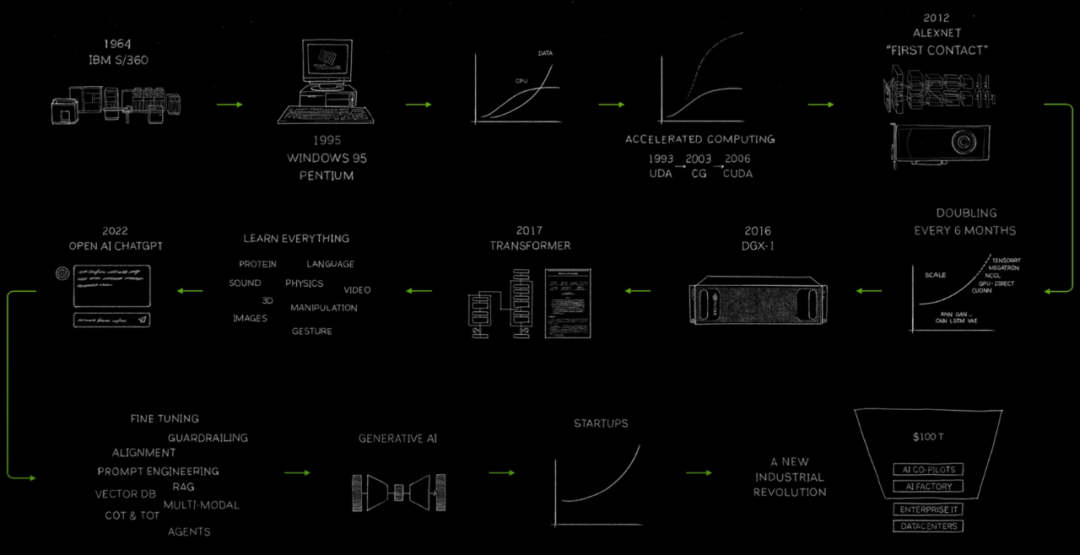

Blackwell GPU登场之前,黄仁勋先回顾了英伟达30年发展历程,他认为沿途有几个重要里程碑。

首先是2006年,CUDA发布,黄仁勋表示,后来被证明是一种革命性的计算模型。

“我们当时认为它是革命性的,以为它将一夜之间获得成功。”黄仁勋如是表示,

从后续发展来看,CUDA确实配得上“革命”这个词。

作为一项同时支持硬件和软件的技术,CUDA可利用图形处理器中的多颗计算核心进行通用计算处理工作,极大加快了开发模型的训练速度。

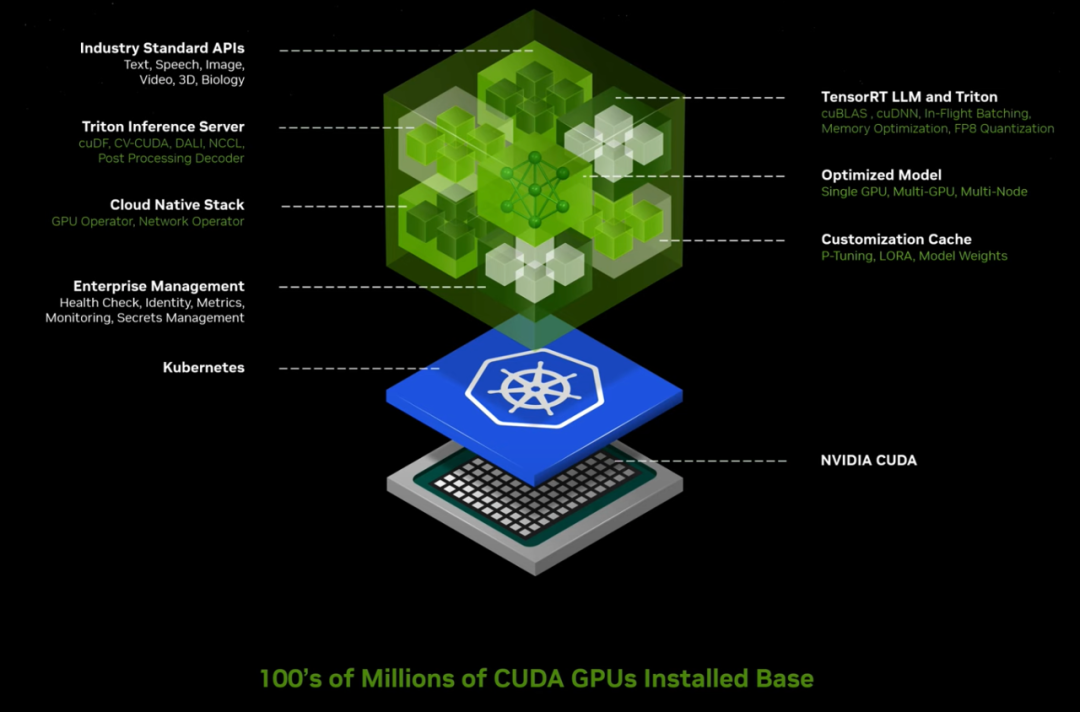

可以简单理解为,CUDA是英伟达实现软硬件适配的一种架构,而软件生态决定了产品的适用性,计算平台决定了硬件的使用效率,CUDA是英伟达实现生态的绝对护城河。

不过,外界认识到CUDA的价值还是将近10年之后。

2016年,AlexNet与CUDA首次接触,一种名为DGX1的新型计算机诞生,首次将170teraflops和8个GPU连接在一起。正如外界了解那样,黄仁勋笑言,“我亲自交付了第一台DGX1给一家位于旧金山的初创公司,名为OpenAI”。

2017年,Transformer到来。

2022年,ChatGPT捕获了世界的想象力,人们意识到人工智能的重要性和能力。

2023年,生成式AI出现,新的行业开始形成。

“为什么是一个新行业?”黄仁勋表示,因为这样的软件以前从未存在过,我们现在正在使用计算机编写软件,这是一个全新的类别,它从无到有占据了市场份额,生产软件方式与此前在数据中心所做的完全不同。

面对全新的市场和需求,需要更强大的GPU。

“Hopper很棒,但Blackwell更好”。黄仁勋认为,生成式AI是这个时代的决定性技术,Blackwell是推动这场新工业革命的引擎。

根据黄仁勋介绍,Blackwell GPU有6大创新技术,包括:

全球最强大的芯片。具有2080亿个晶体管,采用专门定制的双倍光刻极限尺寸4NP TSMC工艺制造,通过10 TB/s的片间互联,将GPU裸片连接成一块统一的GPU。第二代Transformer引擎。得益于全新微张量缩放支持,以及集成于TensorRT-LLM和NeMo Megatron框架中的英伟达动态范围管理算法,Blackwell将在新型4位浮点AI推理能力下实现算力和模型大小翻倍。

第五代 NVLink。为了提升万亿级参数模型和混合专家AI模型的性能,最新一代 NVIDIA NVLink为每块GPU提供1.8TB/s双向吞吐量,确保多达576块GPU之间的无缝高速通信。

RAS引擎。采用Blackwell架构的GPU包含一个用于保障可靠性、可用性和可维护性的专用引擎。此外,Blackwell架构还增加了多项芯片级功能,能够利用AI预防性维护来运行诊断并预测可靠性相关的问题。这将最大程度延长系统正常运行时间,提高大规模AI部署的弹性,使其能够连续不间断运行数周乃至数月,同时降低运营成本。

安全AI。机密计算功能可以在不影响性能的情况下保护AI模型和客户数据,并且支持全新本地接口加密协议。

解压缩引擎。专用的解压缩引擎支持最新格式,通过加速数据库查询提供极其强大的数据分析和数据科学性能。

在黄仁勋看来,未来几年,每年需要企业花费数百亿美元的数据处理将越来越多地由GPU加速。02多次迭代,英伟达不断拉大与对手差距之所以取名Blackwell是为了致敬美国科学院首位黑人院士、杰出统计学家兼数学家David Blackwell,其擅长将复杂的问题简单化,独立发明的“动态规划”、“更新定理”被广泛运用于多个科学、工程学等多个领域。而这,也是每一代英伟达GPU架构的命名习惯。GPU的概念,是由英伟达在1999年发布Geforce256图形处理芯片时首先提出的,从此英伟达显卡的芯就用GPU来称呼,它是专门设计用于处理图形渲染的处理器,主要负责将图像数据转换为可以在屏幕上显示的图像。

与CPU不同,GPU具有数千个较小的内核(内核数量取决于型号和应用),因此GPU架构针对并行处理进行了优化,可以同时处理多个任务,并且在处理图形和数学工作负载时速度更快。

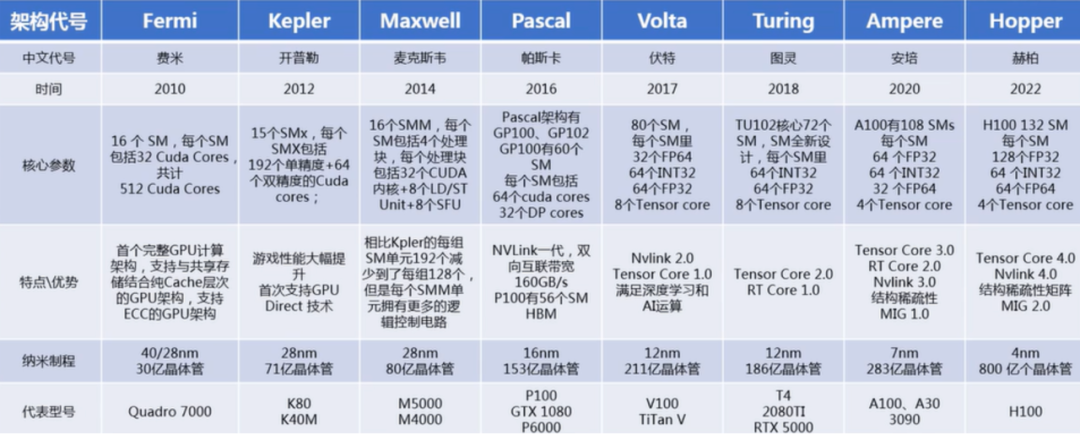

随后20多年时间,英伟达每隔1-2年提出新的芯片架构以适应计算需求升级,陆续推出Tesla、Fermi、Kepler、Maxwell、Pascal、Volta、Turing、Ampere和Hopper等。不断增强GPU的计算能力和程序性,推动GPU在图形渲染、人工智能和高性能计算等领域的应用。

比如,2020年Ampere架构在计算能力、能效和深度学习性能方面大幅提升,采用多个SM和更大的总线宽度,提供更多CUDA Core及更高频率,引入第三代Tensor Core,具有更高的内存容量和带宽,适用于大规模数据处理和机器学习任务。再比如,2022年发布Hopper架构,支持第四代TensorCore,采用新型流式处理器,每个SM能力更强。

可以理解为,GPU架构的更新主要体现在SM、TPC(CUDA核心的分组结构)增加,最终体现在GPU浮点计算能力的提升。

从Pascal架构到Blackwell架构,过去8年,英伟达将AI计算性能提升了1000倍。“在Blackwell架构下,芯片之间可连接构建出大型AI超算集群,支撑更大的计算需求。”黄仁勋表示,GPU的形态已彻底改变,未来英伟达DGX AI超级计算机,就是AI工业革命的工厂。从数据和性能看,英伟达的GPU产品在AI训练上的性能和水平,确实与全球其他玩家的差距在进一步拉大。这也使得英伟达芯片在大模型训练领域占比不断提升,但受限于芯片管制、产能等因素,在推理市场,英伟达丢失了一些份额。03生成式AI微服务推出,打造AI应用级入口两周前,英伟达在CUDA11.6更新版本中强调:“禁止其他硬件平台上运行基于 CUDA的软件”。显然,它想要训练和推理芯市场一起抓。为了上述目标的实现,光有硬件还不够,软件护城河也要跟上。

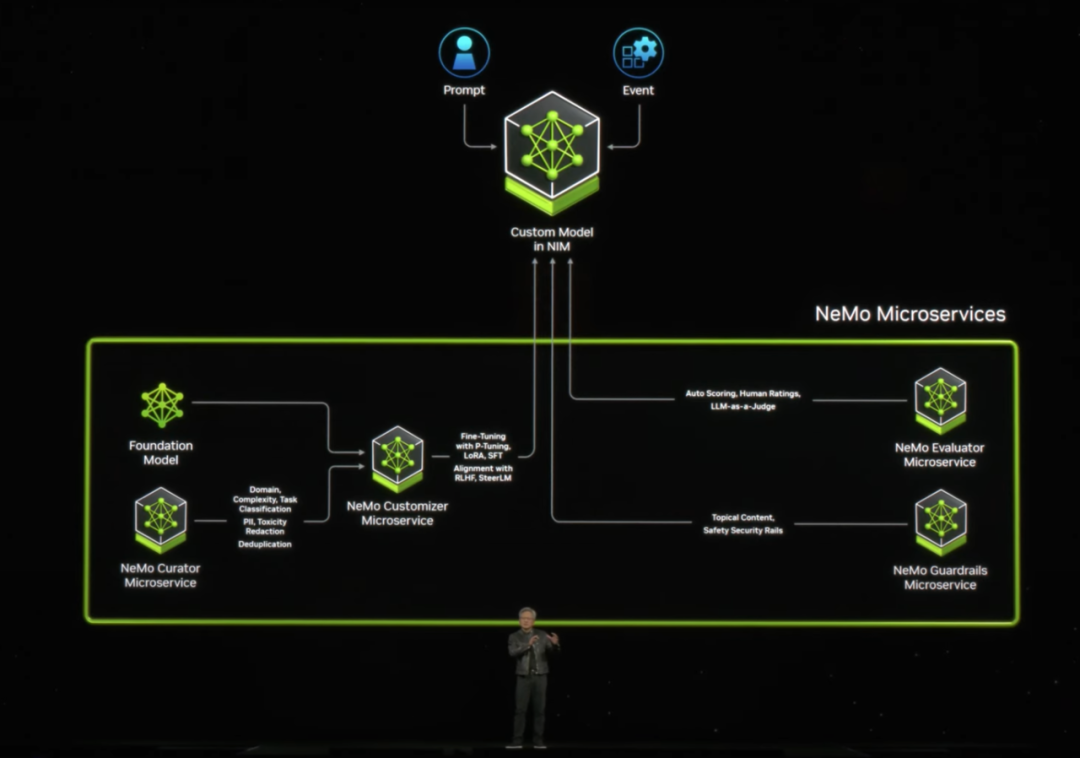

因此,在讲完硬件生态之后,黄仁勋开始介绍在AI软件方面的创新,即生成式AI微服务NIMS(Nvidia Inference Micro Service)。

在黄仁勋看来,生成式AI改变了应用程序编程方式。未来,企业不再编写软件,而是组装AI模型,指定任务,给出工作产品示例,审查计划和中间结果。而NIM的出现能够让这件事的实现更加简单。黄仁勋希望,用NIM平台,支持应用厂商开发智能应用,将NIM打造为CUDA生态之后的一个AI应用级入口,增加生态护城河价值。据介绍,英伟达NIM是英伟达推理微服务的参考,是由英伟达的加速计算库和生成式AI模型构建的。微服务支持行业标准的API,在英伟达大型CUDA安装基础上工作,并针对新的GPU进行优化。“企业可以利用这些微服务在自己的平台上创建和部署定制应用,同时保留对知识产权的完整所有权和控制权”。据黄仁勋介绍,NIM微服务提供基于英伟达推理软件的预构建容器,使开发者能够将部署时间从几周缩短至几分钟。它们为语言、语音和药物发现等领域提供行业标准API,使开发者能够使用安全托管在自己的基础设施中的专有数据,来快速构建AI应用。这些应用可按需扩展,从而为在英伟达加速计算平台上运行生产级生成式AI提供灵活性和性能。

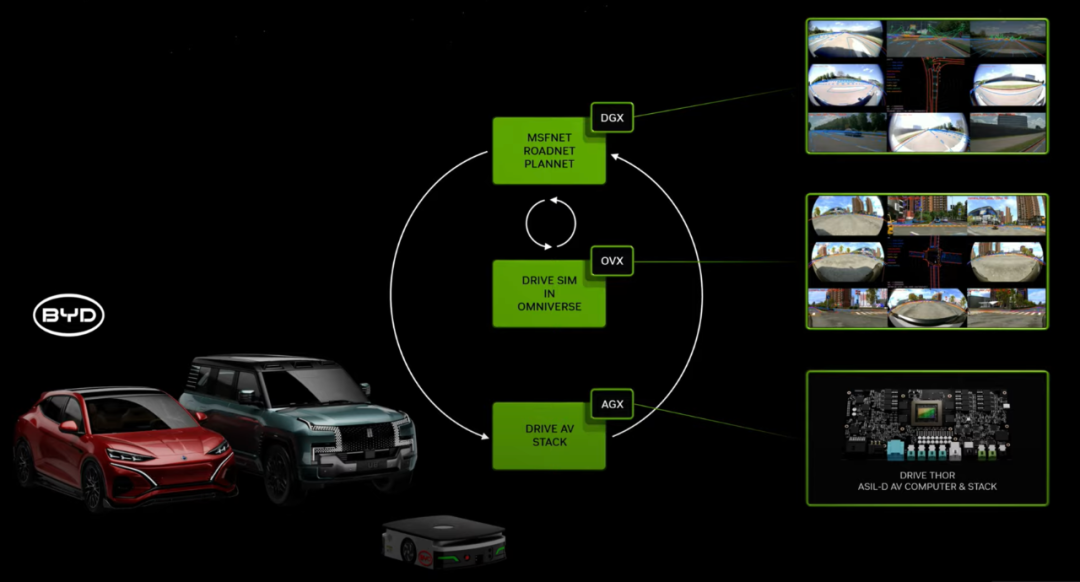

用户将能够从亚马逊SageMaker、谷歌Kubernetes Engine和微软Azure AI中访问NIM微服务,并与Deepset、LangChain和LlamaIndex等AI框架集成。同时,为助力各行业加快开发生产级AI,CUDA-X微服务还为数据准备、定制和训练提供端到端的构建模块,企业可以使用CUDA-X微服务,包括用于定制语音和翻译AI的Riva、用于路由优化的cuOpt,以及用于高分辨率气候和天气模拟的Earth-2。与此同时,英伟达还在不断打造相关生态系统,包括Abridge、Anyscale、Dataiku、DataRobot、Glean、H2O.ai、Securiti AI、Scale.ai、OctoAI和 Weights & Biases等数百家AI 和 MLOps企业将通过AI Enterprise来支持英伟达微服务。04AI+汽车落地,英伟达继续扩大汽车朋友圈技术价值的实现,最终需要落地。演讲中,黄仁勋还介绍了AI+医药、AI+汽车、AI+家电、AI+工业设计以及AI+机器人等方面的进展。其中,汽车方面,黄仁勋透露,比亚迪不止采用英伟达集中式车载计算平台Drive Thor开发下一代电动车,还计划将英伟达的AI基础设施用于云端AI开发和训练技术,并使用英伟达Isaac与Omniverse平台来开发用于虚拟工厂规划和零售配置器的工具与应用。

除了比亚迪之外,其他多家汽车制造商和自动驾驶卡车开发商也宣布扩大与英伟达的合作。广汽埃安旗下高端豪华品牌昊铂宣布其下一代电动汽车将采用DRIVE Thor平台,新车型将于2025年开始量产。小鹏宣布将把DRIVE Thor平台作为其下一代电动汽车的“AI大脑”。这款新一代车载计算平台将助力该电动汽车制造商自研的XNGP智能辅助驾驶系统,实现自动驾驶和泊车、驾乘人员监控等功能。DRIVE Thor是英伟达于2022年9月发布的最新一代Drive平台。彼时,英伟达方面称,这颗SoC芯片内部拥有770亿个晶体管,可实现2000 TOPS的AI算力,或者是2000TFLOPs。根据英伟达介绍,除乘用车外,DRIVE Thor在自动驾驶领域也在持续扩张。

其中,Nuro正致力于开发用于商用车和乘用车的L4级自动驾驶技术,该公司选择DRIVE Thor为Nuro Driver提供助力;智加科技宣布,其L4级解决方案SuperDriv的下一代产品将在DRIVE Thor计算平台上运行;文远知行正在与联想车计算一同基于DRIVE Thor来创建多个商用L4级自动驾驶解决方案。可以预见,伴随着Blackwell架构和Thor芯片的推出、落地,英伟达将进一步巩固在智能驾驶、人工智能等领域的地位。