AI亲手裁掉人类,谁赋予了它“非人化”的权利?

互联网那些事一美国Facebook的外包员工控诉陈,他们被一种算法裁掉了,在被AI判定没有正常完成工作后,当场被机器自动发送的一封邮件解雇。

比AI取代自己工作更令我们慌乱的,是AI已经正在亲手裁掉我们人类。

那些躲在AI数据背后的老板和人力资源都将不再承担责任,使劳动关系非人化,将人力资源中的“人力”彻底剥离。西班牙劳动法专家曾表示,如果这一趋势持续下去,人力资源部门将面临“非常黑暗的未来”。

帕斯夸尔曾认为,“数字老板”永远都会是暴君,因为它把人当作非人来对待。AI到底能否取代人类在具有明确道德含义领域的经验和推理能力?人工智能的权力责任标准又该如何衡量?是谁赋予了AI决定人类去留的权利?

01.被裁员前的“预告片”

阿尔法狗(AlphaGo)吊打职业围棋手柯洁,因为它有了类似人脑的种种功能:庞大的数据库,自我学习能力,以及找到更好解决方法的能力。

在与阿尔法狗接连对战的几个回合后,阿尔法狗的棋艺再次增长,“现在它越来越接近上帝了”,赛后的柯洁称。

阿尔法狗的核心系统采用了机器学习与神经系统科学结合的学习算法,还通过大量数据分析学习了3000多万步的职业棋手棋谱,再通过增强学习的方法进行自我博弈,寻找更好的棋路。

从乌镇互联网大会,李彦宏坐无人驾驶开入五环,腾讯高调进军AI...人工智能正在以指数级增长渗透进我们的生活乃至整个世界,随着他们飞速旋转的“大脑”,未来也将取代人类绝大部分的工作。

澳洲一家教学机构培生教育(Pearson's)的新研究结果显示,人工智能和自动化正在渗入澳人的日常工作生活。随着科技进步,越来越多职业可能被自动化。

谷歌的无人驾驶每8250km才故障一次,职业司机或将成为被取代的职业中首当其冲的一种;再次是医生,云端大数据及数据库甚至更精准的操作可以完全取代他们的工作;服务业中大量重复性的工作如裁缝、服务员、抄写员,或是高空危险作业的消防、反恐都将接受来自AI的洗礼。

尤其是在翻译领域,今年市场上已经开始出现较为成熟的人工智能翻译机产品,如科大讯飞推出的晓译和译呗,清华技术团队推出的准儿。而在产品测试中,中英翻译普遍达到了95%以上的准确率,完美解决文科不能解决工程企业翻译等需求。

与人类的大脑相比,AI大脑的神经元是科学家们赋予的大脑神经,根据数据显示,以一秒钟的时间为单位,人工智能的电子神经元激活次数约为上亿次,而人类的大脑神经元,则仅有200次,至少是300万倍的差异。

也就是说,柯洁在思考下一步棋该如何走的时候,AI已经思考了接下来近300万步的可能。

硅谷大佬马斯克曾多次警告,机器会杀死人类,培养他们的同时激活他们体内的自主意识,目前这个说法并没有得到科学界的印证,反倒是“AI与人类优势互补”的说法盛行。

面对爆炸性增长的巨量信息,AI确实可以高效率、高记忆力、低出错率的解决复杂无比的难题;但AI没有办法复刻人类的发散性、创造性智慧,关键时候的应变能力、肢体语言能力及情感能力。

对于当前的AI来说,他们唯一能感受到的只有电流和数字组成的“思考力”,处理简单可重复的工作是他们的强项,但代替HR裁掉员工,就是另外一种说法了。

02.AI成为人类“暴君”

后疫情时代,科技公司纷纷开源节流。

Facebook上曾有员工控诉称,自己被一种算法裁掉了,他们与埃森哲签订劳动合同,但是在Meta的办公区工作,突然有一天通过视频会议得知自己必须离职,而公司给出的裁员理由是“随机”。

此前,Xsolla的工资预算降低了10%,在近一年时间里,Xsolla增长持续放缓,年增长率一度低至40%以下。

在Xsolla CEO眼里,公司效益不好是因为员工不在公司上班导致懈怠造成的,在使用AI算法后,直接通过邮箱解雇了450名员工中的150位。

随后首席执行官向Aleksandr Agapitov向所有被解雇员工发去了一封邮件:如果你的“数字足迹”没有达到公司的标准,那么你一开始就不适合Xsolla。

亚马逊也一直在算法裁员的路上。

在亚马逊兢兢业业工作了4年的斯蒂芬·诺曼丁在亚利桑那州凤凰城送货时,与往常一样打开APP查看送货路线,却发现账号无法登录。

同时他收到了一封来自亚马逊的自动邮件:你已经被 amazon 终止合作,原因是:由算法给出的个人评分已经低于Amazon的规定分数。

诺曼丁非常不满公司对他的决定,他认为AI不能因为无法控制的意外而惩罚他,比如进出小区不便,路上堵车或客户不在等情况,他也对自己手头上的工作有着极高的自豪感,根本无法接受“履职不到位”的最终评价。

这是对司机的算法,对于亚马逊内部的仓库人员来说,只要行动不够快就可能失去工作。亚马逊会跟踪每一位工人的生产效率,并相应的形成警告或裁员通知,全程没有人力资源的半点影子。

这与国内外卖小哥的考核方法相似,平台通过AI算法计算出最快的路线及最少的时间,没有完成便会扣钱,甚至解雇。

在接受一次CNBC采访时,亚马逊创始人贝佐斯曾表示,一切决策都倾向于交给AI算法,只有战略决策才是必须交给人类的商业决策,因为机器“只会考虑相关信息,完全没有情感干扰”。在他眼里,人工智能可以优化大部分的流程,为实现长期的就业目标提供机会。

除了解雇,亚马逊的AI系统还负责招聘,但因其用人公平性屡遭质疑致关停,原因是在AI系统的学习过程中认为过去十年中被雇佣的大多是男性,因此在审核申请人时会对“女性”词条进行降格处理。

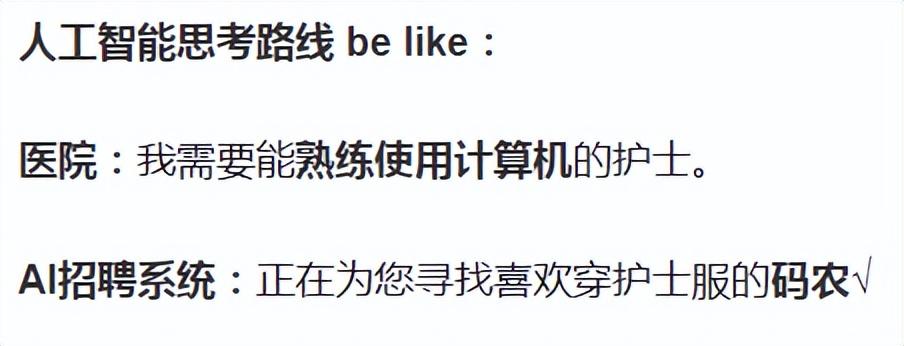

在各大企业用工荒的时候,AI招聘系统也会死脑筋的却把成千上万的员工简历丢进大海,哈佛大学首席研究员约瑟夫·富勒 (Joseph Fuller) 曾举例:医院扫描注册护士简历时,用AI进行了“计算机编程”技能的筛选,而医院仅仅需要的是可以将患者数据输入计算机的人。

此外就连薪酬部分的工作也被AI接替,字节跳动曾公布过一项专利技术“员工薪资方案生成方法及装置”,他可以获得员工薪资方案创建请求、输出员工薪资方案末班、获取薪资项目、为目标薪资项目配置参数、修改参数、生成方案.....

其实按照这个道理来说,最先被裁的应该是HR。AI 算法成本更低、效率更高、寿命更长,相比之下,在原本岗位上的员工要是不好好修炼自己,只能另谋出路。

但正如诺曼丁不满亚马逊的裁员决定般,AI的不灵活性致使了他的失业,AI到底能否决定员工的去留?谁来对AI的“不负责行为”买单?

03.AI=不知者,无罪!

“老板和人力资源部门都不承担解雇的责任,躲在算法和其他技术创新背后推卸责任,进一步使劳动关系非人化。”西班牙劳动法专家法比娅·内瓦多评价说,尤其针对一些工资与手底下人能力相挂钩的管理层人士来说。

在内瓦多眼里,将人力资源的工作完全交给AI会让不少关键职位处于危险的不利动荡中。《机器人新定律》一书中提出,人工智能永远不应取代人类在“具有明确道德含义的领域”的经验和推理能力。

也就是说,人类不应授权机器来决定谁会被解雇,因为这样的决策无法实现自动化,不能脱离“负责任的反思”这一过程。

关于AI到底归谁管这个问题,我们分成2个部分来看:谁负责,谁拥有。

曾经一工厂的机器人误把一名员工当作其执行任务的威胁,并计算得出消除威胁的最有效方法是把其推向附近一台正在运行的机器,从而立刻杀死他。那么关键问题就在于,设计机器的程序员及工厂是否知晓其使用过程会导致这一结果,如果知晓则共同承担责任,若不知晓,仍要共同承担,同时销毁机器罢了。

就比如无人驾驶的汽车在其行驶车道上超速,深圳曾规定若出了事故,则由车辆所有人、管理人承担责任,但不对车主进行扣分处理。

目前为止,关于人工智能为何有或没有法律地位,为何以及如何承担法律责任,学界一直争论不休,导致AI法学的研究出现“泡沫化”倾向,人工智能领域的研究院称:“机器人有道德和法律上的义务,甚至权利吗?人工智能的行为和决策的自主空间越大,谁对其决策和行为承担责任这个问题的提出就越紧迫。”

因此到底谁对AI负责的问题,从不同视角出发有着不同的处理结果,而人类的法律是否适用于AI?只有在了解过程全貌才能找到准确的适用办法,这对于还在成长期,持续高速变化的AI来说很难实现。

自2013年和人工智能有关的34万项专利中,有53%都已被发表,其中中国一骑绝尘,是发表成果最多的国家。AI的精神成果到底会不会被人类认可,取决于人类是否认可AI发明者的身份,以及AI是否具有保护自己知识产权的权利。

也就是说如果我们要认可AI的一切决策及成果,首先我们必须要求AI知道自己在做什么。

在西班牙工会UGT一份名为《劳资关系中的算法关系》文件中称,如果使用AI算法解雇员工,其标准必须透明 ,算法与人工智能的任何一款产品一样都会出错,甚至AI根本不用担心自己的决定会对“人民的安全或基本权利”产生什么样的影响。

如果AI在不具有“明确道德含义”的领域做出了侵权或是损害人民的行为,那一定是由算法决策的失误导致。算法决策所依据的或系统所训练的数据集一旦受到来自外部干扰或新型介质的出现,其几秒钟就能完成的演算并非人工智能的设计者利用规范过程模型就能解决的。

因此,AI的处理结果完全不可控,它的行为不具有可解释性,人类设计出的人工智能的行为不能完全按照人的意志去发展,是个黑洞。

尽管在未来的某一天AI会取代我们的工作,也会代替部分人类做出绝对正确的决策,但要记住最后的胜者永远都是人类,就如柯洁在战败后,科学家仍得出“人类是赢家”的结论。

参考:

人工智能不仅会取代你的职位,现在还要亲手裁掉你——Vista看天下

人工智能的可解释性与AI的法律责任问题研究——刘艳红

用 AI 辞退150人,HR恐要丢掉工作——人力资源汇

人工智能会取代人类吗?科学家:它们已经会“放气球”——奇点使者