给手机“减负”!Facebook发布提高设备AI工作能效的AutoScale

将门创投

决定AI应用在智能手机上终端还是在云端运行,对于用户和开发AI应用的企业都十分重要,因为这与运行设备的长期电池寿命息息相关。大多数智能手机都或多或少地嵌入了AI应用,但如果所有的AI工具都在终端运行,有可能导致手机性能下降;而在云端运行,则可能导致较长的调用时间。

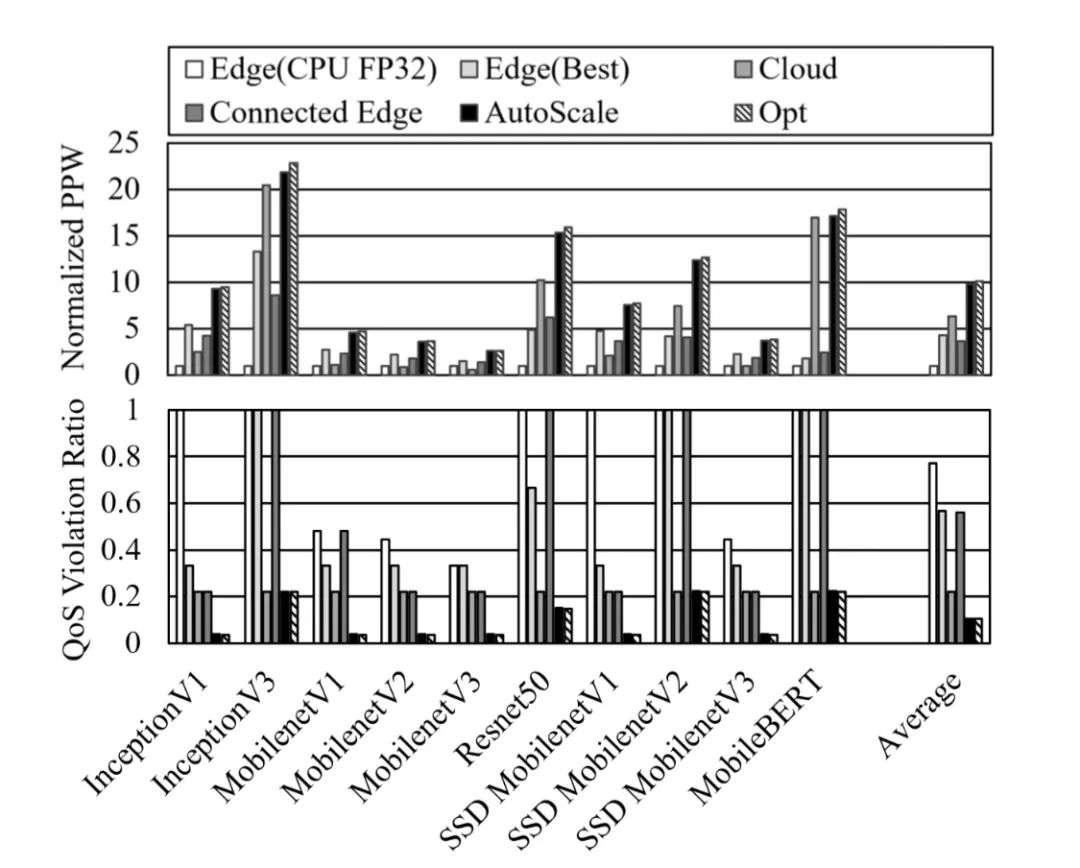

为了解决这一问题,近日Facebook和亚利桑那州立大学建立了一个支持AI减轻设备负荷的模型——AutoScale。该模型能够自动决策部署AI运行的位置,节省了大量成本,将AI工具的能效提高到基线方法的10.8倍;更能准确预测AI应用的合适位置,达到高性能和低能耗兼备的理想效果。

高能效+低负荷

AutoScale:挖掘强化学习算法的潜能

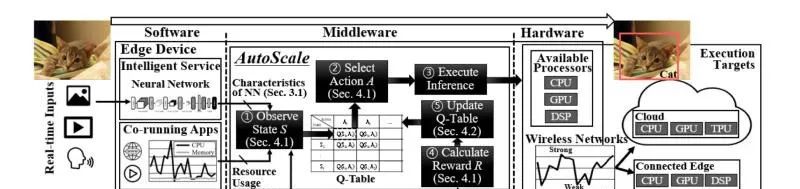

AutoScale会观察当前的AI工作执行效率,包括算法的架构特征和运行时间差异。它在协同处理器等硬件之间选择,找到能够最大限度提高能源效率的硬件,以保证AI助手的服务质量。对选定硬件定义的目标执行推理后,通过观察其结果,包括演算运行能耗、延迟度和推理精度,以表明选中的硬件是否提高了AI工作效率。

AutoScale模型

AutoScale基于强化学习算法,计算累计奖励(R值),来选择AI工具的最佳运行方式。例如:对于给定的处理器,系统使用基于AI能效利用率的模型计算奖励,假设处理器内核消耗的功率是可变的,内核在繁忙和空闲状态下花费的处理时间不同,其能源使用情况也各不相同。相比之下,当推理扩展到连接的数据中心时,AutoScale可以借助基于信号强度的模型来计算奖励,预测传输延迟度和网络消耗的能量。

在适应QoS限制条约的前提下,比起基线模型,AutoScale更能提高能效。

1 2 下一页>