爆火的ChatGPT,能让自动驾驶成为老司机吗?

光锥智能

文丨光锥智能,作者丨周文斌

元宇宙已经凉透了,NFT也快淹死了,但中国互联网不知道,中国互联网不在乎,因为现在它的眼里只有ChatGPT......

这是最近两个月来中国互联网的真实写照,大家都在为ChatGPT狂欢,周鸿祎更是语出惊人:“任何行业的APP、软件、网站、应用,如果加持上GPT的能力,都值得重塑一遍。”

就像是发令枪扣动了扳机,在ChatGPT之后,人工智能直接开启了科技企业的狂热竞赛。国外从微软到谷歌;国内从百度到腾讯、再从阿里到字节,巨头们纷纷下注,买定离手。

2月份,这把火终于烧到了自动驾驶领域,2月17日,毫末宣布将自动驾驶认知大模型正式升级为DriveGPT,并将在4月份公布进展。目前,毫末智行已完成DriveGPT的模型搭建和第一阶段数据跑通,可以对标GPT-2的水平。

而在2月23日的财报发布会上,百度也专门提到要将文心一言与Apollo自动驾驶结合。按照部署,未来文心一言背后大模型技术在自动驾驶上的应用,将加深车辆对复杂城市路况的理解,进一步提升自动驾驶安全性和可靠性。

要知道,在ChatGPT之前,自动驾驶一直是人工智能最具代表性的应用,而ChatGPT作为人工智能领域的革命性突破,必然也将对自动驾驶带来影响。

关于这个问题,光锥智能也曾询问ChatGPT。

ChatGPT“认为”,自动驾驶作为一种新兴技术,虽然可能面临一些道德问题,但仍然在安全性、经济性和可靠性方面对人类生活产生深刻影响。而作为一种自然语言处理的人工智能模型,ChatGPT可以在智能交互、数据处理,路况分析、人机交互,以及在社会和伦理问题的研究上提供支持。

那么具体而言,ChatGPT会给自动驾驶的发展带来哪些变革呢?同样作为人工智能的应用方向,它又和自动驾驶有着怎样的渊源?又会给自动驾驶的发展路径带来哪些启示?

一、ChatGPT和自动驾驶的渊源

ChatGPT能直接应用在自动驾驶领域吗?

谈起这个问题,了解自动驾驶和ChatGPT的人第一反应肯定都是“不行”。

原因很简单,ChatGTP本质上是一种自然语言处理技术,它主要处理文本数据来实现对人类语言的理解和生成。但自动驾驶则更多涉及车载传感器,如摄像头带来的图像、以及激光雷达和毫米波雷达带来的雷达数据。

所以虽然同样属于人工智能技术,但两者看起来并没有太多直接的关系。当然,这样的区分只是局限在应用场景的不同,如果回溯背后的技术原理,ChatGPT与目前自动驾驶使用的主流技术其实有相当多的共同特点。

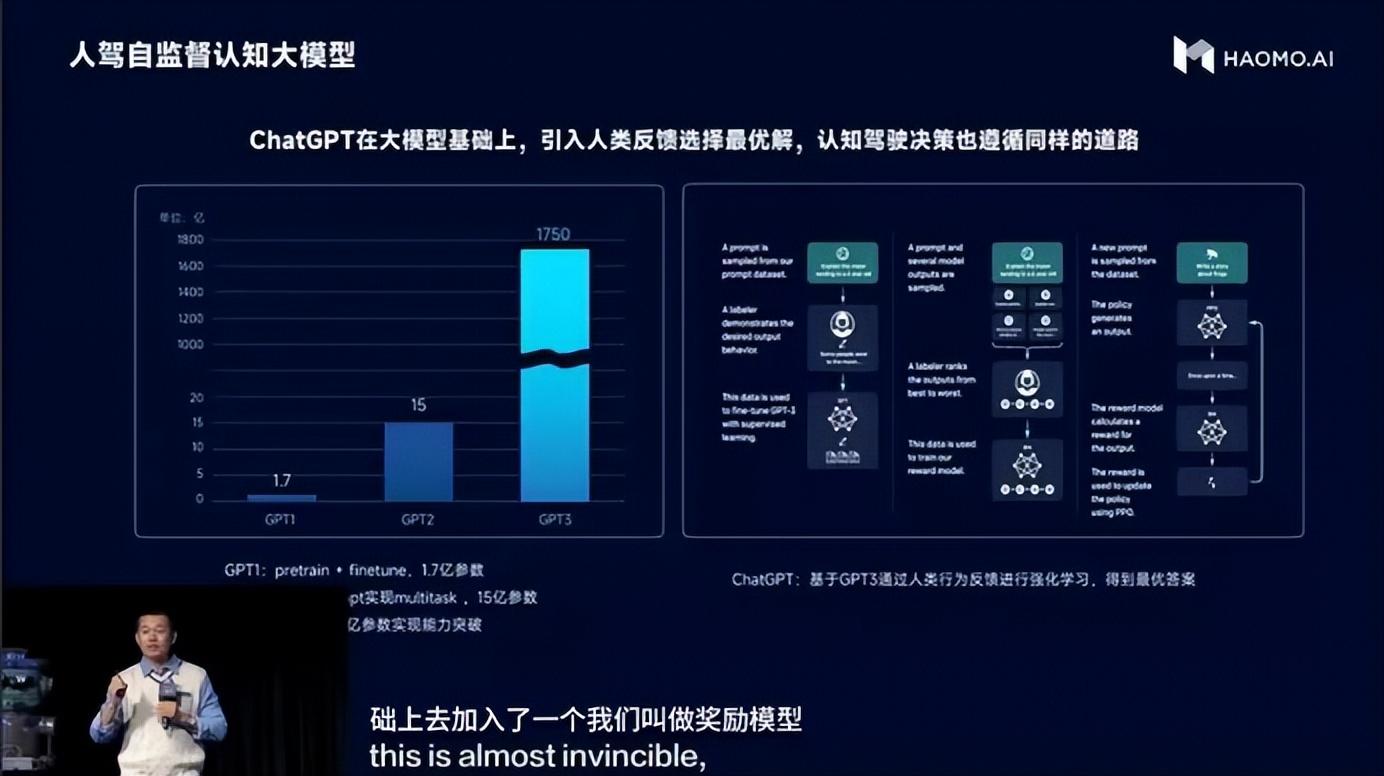

毫末智行CEO顾维灏介绍,毫末推出的人驾自监督认知大模型就已借鉴了ChatGPT的实现思路,采用RLHF(人类反馈强化学习)技术,通过引入真实人驾接管数据,对自动驾驶认知决策模型进行持续优化。

我们知道,ChatGPT是基于Transformer训练的NLP大模型。2017年,谷歌在NIPS发表论文《Attention is all you need》提出了Transformer网络结构。之后,由于其优秀的长序列处理能力,更高的并行计算效率,无序手动设计特征,以及更强的语义表达能力,Transformer横扫NLP领域并成为最主流的训练模型。

简单来说,Transformer极大程度上提高了超大规模数据训练的效率,所以在NLP领域取得成功之后,Transformer就延伸出了许多变种被应用到更多场景,其中就包括自动驾驶需要的图像识别和目标检测。

比如ViT(Vision Transformer)模型,它是一种基于Transformer的视觉模型,可以在不使用CNN卷积神经网络的情况下进行图像分类。或者DETR,一种基于 Transformer的目标检测模型,它可以同时进行目标检测和分类。

2021年6月,在顶级峰会CVPR 2021上,时任特斯拉AI高级总监的Andrej Karpathy首次提出将Transformer运用到自动驾驶的大规模无监督训练中。(今年2月初,Karpathy在Twitter上宣布再次加入OpenAI。)

如今,在关于Transformer在自动驾驶方面的应用上,特斯拉已经有了许多具体场景,比如从BEV感知到占用网络。

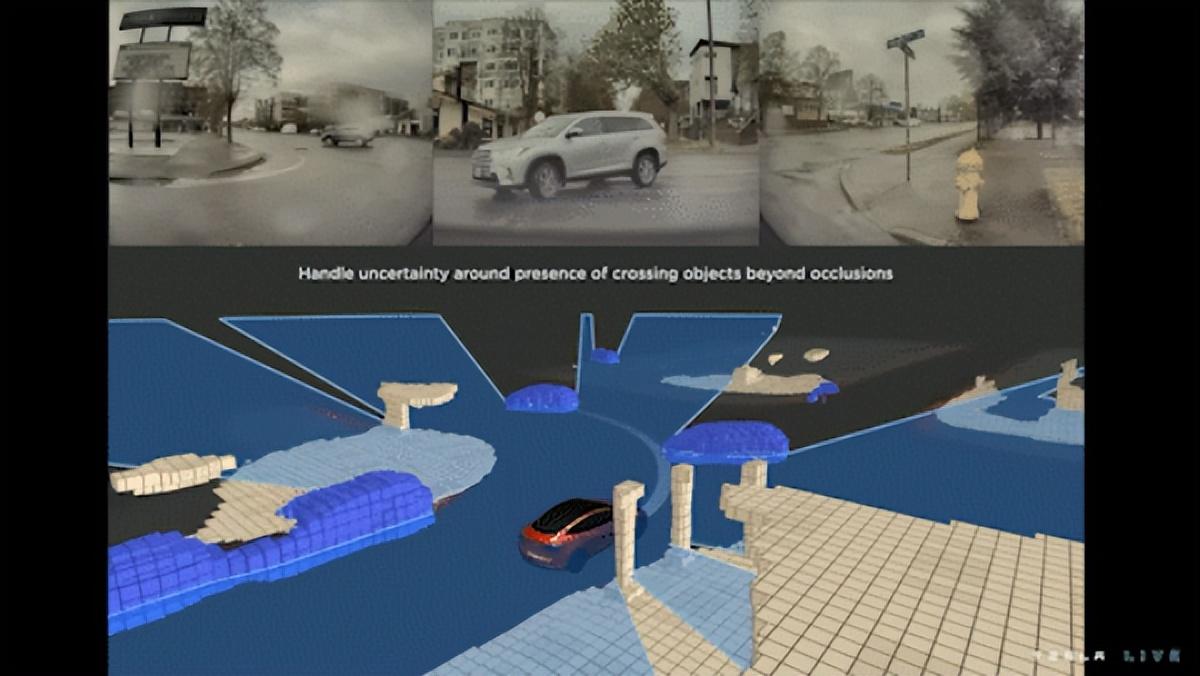

最早,特斯拉在车辆感知上使用的是Occupancy Tracker,即在每个相机上单独进行感知,再将不同相机感知到的结果进行融合。

但这种方式存在许多问题,比如不同摄像头之间的信息融合困难,鬼探头等遮挡区域的预测困难,以及一些巨大物体(当一个物体跨过两个摄像头的范围后)的预测困难等等。

面对这些问题,特斯拉AI团队希望利用神经网络将图像空间映射到BEV空间。

所以在2021年的AI DAY上,特斯拉提出了新的BEV感知方案,可以跨过传统图像缝合技术,直接将所有摄像头采集的图像矫正后,一并输入到神经网络提取特征。然后再基于Transformer将这些特征进行关联从而投影到一个BEV空间上,最终获得一个反应周围环境的鸟瞰图。

到2022年底的AI DAY,特斯拉又提出了occupancy network 占用网络,这是一种新的基于机器学习的三维重建方法,依靠它特斯拉可以把车辆行驶时遮挡静止物体和动态物体通过有颜色的小方块表示出来,以此来增加特斯拉的视野范围,让特斯拉可以对接下来的路径规划有更多信息。

这些其实都是ChatGPT同源技术在自动驾驶方面的应用,而具体到国内,在特斯拉首次提到将Transformer运用到自动驾驶2个月后,毫末就曾公开表示正在利用Transformer进行超大规模的感知训练,并且后期有可能将Transformer引入到规划和控制中。

到2022年,小鹏在1024科技日中也提到使用大模型打通XNGP全场景能力的观点;百度Apollo也认为文心大模型将是提升自动驾驶能力的核心驱动力。

总之,在尝到Transformer的甜头之后,自动驾驶企业纷纷将其引入到自动驾驶系统中,以此来实现系统感知智能与认知智能的优化。

再回到ChatGPT,我们知道ChatGPT基于GPT-3训练,但这个模型发布于2020年5月,虽然当时在数据规模上做出了突破,但却并没有像ChatGPT一样一鸣惊人。

关于这一点,顾维灏认为,实现GPT3到ChatGPT的龙门一跃,最重要的是ChatGPT模型使用了“利用人类反馈强化学习RLHF”的训练方式,更好的利用了人类知识,让模型自己能够判断其答案的质量,逐步提升自己给出高质量答案的能力。这个思路,与毫末在自动驾驶认知决策上的思路不谋而合。

如同GPT-1到GPT-2一样,毫末在自动驾驶认知的训练最开始也是从引入个别场景,让模型进行端到端的模仿学习开始的,这个阶段算法直接拟合人类的驾驶行为。在这个基础上,自动驾驶的第二阶段引入海量的正常人驾驶数据,通过Prompt的方式实现认知决策。

但这个过程也会遇到一个问题,即自动驾驶算法学习的是所有“正常人类”的驾驶行为,这些数据中可能有高水平的,有低水平的,但机器无法分别,最终学习的结果就是达到一个综合所有数据的平均水平。

为了解决这个问题,今年1月,毫末智行在AI Day上发布了人驾自监督大模型,这个大模型如OpenAI在GPT-3上做的RLHF一样,引入真实人类驾驶员的接管数据对自动驾驶进行强化学习。

即自动驾驶车辆在行驶过程中,人类的每一次接手本质上可以理解为当前阶段的自动驾驶解决方案的不满意,而人类接手后的驾驶方案可以理解为更优的决策。所以通过对人类接手后驾驶方案的学习,能够让自动驾驶做出更像人的驾驶行为。

在当时的AI DAY上,毫末智行CEO顾维灏曾提到:“通过这种方式,在公认的困难场景,例如掉头、环岛等,我们的通过率提升了30%以上。”

因此,虽然ChatGPT无法直接应用到自动驾驶,但是ChatGPT的训练过程,以及其面临的具体问题及其解决方案都值得学习,也将对自动驾驶的发展带来深远的影响。

二、ChatGPT的启示

对于自动驾驶来说,除了模型训练方式和具体问题的解决之外,ChatGPT还能给自动驾驶带来哪些启示呢?

第一点,也是最重要的一点,就是ChatGPT给人类实现自动驾驶提供了信心。

如小冰公司CEO李笛所说,大模型某种意义上意味着一种暴力,一种大力出奇迹的状态。ChatGPT也跟它的前身GPT-3模型一样拥有1750亿个参数,这是一种解决方案,即在人工智能这件事儿上,ChatGPT的成功意味着大力出奇迹是可行的。

在ChatGPT之前,困扰自动驾驶从业者一个很重要的问题在于,无穷无尽的corner case是不是真的能够解决完。为了尽可能解决这个问题,一些自动驾驶公司琢磨出数字孪生、3D重建、占用网络等多种方式。

而ChatGPT出现之后,又给自动驾驶解决corner case提供了新的思路,即只要数据量足够多,依靠“人类反馈强化学习”,让自动驾驶有能力应对所有corner case也并非不可能。

而要实现这样的数据训练,大模型就会成为自动驾驶企业的必备技术。所以就像百度自动驾驶技术专家王井东提到的那样:“大模型已经成为自动驾驶能力提升核心驱动力。”

当然,要应用大模型实际上并不简单。

首先面临的就是成本问题,大模型具有参数规模大、数据训练规模大,对算力要求大、成本高的特点。据国盛证券估算,GPT-3训练一次的成本约为140万美元,对于一些更大的LLM(大型语言模型),训练成本介于200万美元至1200万美元之间,折合人民币基本每一次都过了千万。

所以对于自动驾驶企业来说,解决算力问题就变得尤为重要。以特斯拉为例,其在决定将Transformer应用到自动驾驶训练同时,就推出了自己全新研发的超级计算机Dojo,从算力规模上看,当时的Dojo几乎一出道就成功卡位了全球第五大超级计算机。

图:特斯拉 Dojo

在国内,小鹏2022年和阿里云一起在乌兰察布建立了智算中心“扶摇”。更早的2021年底,毫末也曾发布自己的自动驾驶数据智能体系MANA,到今年年初,毫末又进一步宣布建成了智算中心(MANA OASIS)。

所以在大模型背后,算力也将成为未来自动驾驶企业在市场竞争中的核心能力,而在算力充足的基础上,优化算法效率来降低云端的训练成本也会成为重要的技术优势。

除了在成本和算力方面的考虑,自动驾驶与ChatGPT的差异也表现在,相比在网页端,大模型在自动驾驶领域的落地会比较困难。

比如前面提到大模型需要大量的计算资源和存储空间,但车端受限于硬件条件,计算资源和存储空间都有限,而且还要考虑功耗和散热等问题。

除此之外,自动驾驶需要实时地对周围环境进行感知决策,因此大模型的计算速度需要非常快,但从目前ChatGPT的反应速度来看,这显然还有难度。

针对这些问题,目前国内自动驾驶企业也提出了一些解决办法,比如通过定制Transformer专用加速芯片来提升计算效能,以及通过改进车端模型,通过轻量化的模型来提升计算效率。

当然,ChatGPT除了给自动驾驶提供了“大力出奇迹”的信心之外,它更重要的革命性意义在于,让AI模型进入了知识和推理的时代。

这恰恰是当前自动驾驶面临的最大短板,即决策规划缺乏足够的智能。而如果能够将ChatGPT的技术应用到自动驾驶的决策规划上,让模型学会驾驶知识和驾驶策略推理,那么将会极大地拔高整个自动驾驶软件的智能上限。

这里其实和前面提到的毫末人驾自监督大模型是一个逻辑。

顾维灏曾提到,当前基于传统、基于规则的认知算法已经进入瓶颈,很难取得突破。毫末一直在尝试通过人驾自监督大模型的方式来提升自动驾驶决策的效果,使得自动驾驶更像老司机。

百度的尝试也是同样的路径,百度在最新财报电话会上提到,按照部署,未来文心一言背后大模型技术在自动驾驶上的应用,将加深车辆对复杂城市路况的理解,进一步提升自动驾驶安全性和可靠性。

从这个角度,ChatGPT的技术或有可能推动实现L4级别自动驾驶的实现。

除此之外,ChatGPT还可以对自动驾驶场景生成带来帮助。

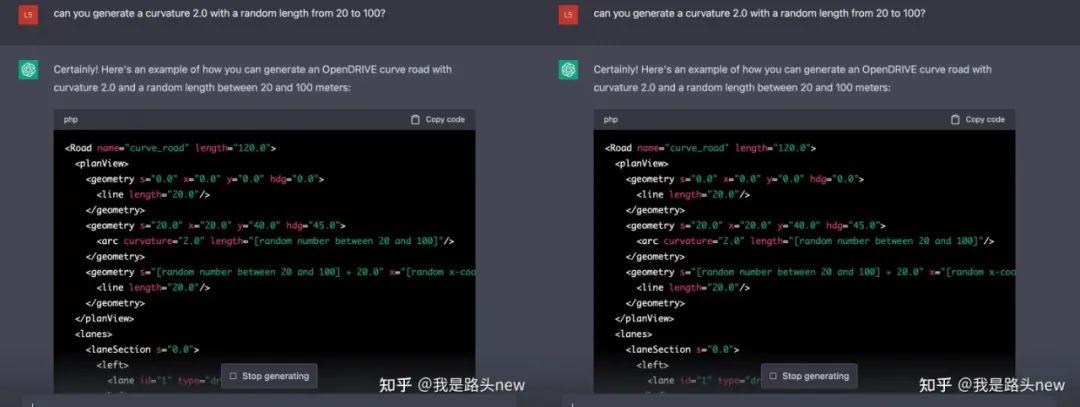

作为软件工程师,知乎作者@我是路头new 在研究如何用OpenScenario 2.0中定义的智能驾驶场景描述语言来进行试车场景提取,语义级别仿真场景生成,仿真场景泛化的过程中使用了ChatGPT。

他让ChatGPT帮忙生成一个Cut-in场景,在给定参数的情况下,ChatGPT能够详细给出基于OpenScenario 2.0的自动驾驶场景数据,甚至在参数不足的时候,它还会提醒作者需要设计其他参数。

同时,作者还测试了一些道路泛化的问题,即不给ChatGPT人为设定参数,而是让限制条件下让ChatGPT自动生成数据。而面对这个问题,ChatGPT也给出了合格的答案。

更重要的是,当作者提问到,是否能够生成之前提到条件下的所有场景,ChatGPT给出了一个科学计算的结果——131000。

对于真正的自动驾驶场景来说,这样的场景生成自然还十分粗浅,但这其实给自动驾驶场景生成,道路泛化提供了另一种思路和可能。

可以说,就像每一次底层技术的创新都会带来大规模的技术裂变一样,ChatGPT虽然不能直接应用在自动驾驶场景,但其背后的技术路径,解决复杂问题的思路,都将为自动驾驶的发展提供最具价值的参考意义。