声音也能做面部识别?这个Vive X团队用AI做到了!

VR陀螺随着VR产业的开枝散叶和走向成熟,VR与众多其他技术的结合也展现出了极大的应用潜力。比如在刚刚结束的Vive X第三批团队Demo Day上,就出现了数家“丢掉”头显、只留下追踪方案+Tracker的企业。

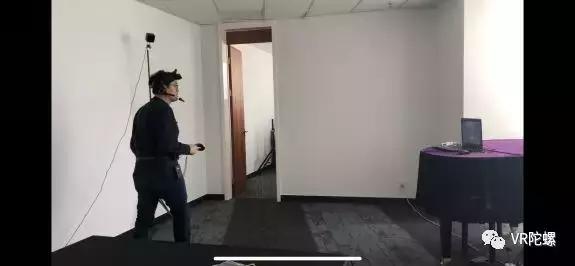

Red Pill Lab是此次Vive X中唯一一支来自台湾的团队。而能够从数千家申请企业中脱颖而出,正是因为公司将独家的AI技术和Tracker相结合,成功实现了低成本的全身动捕方案。在Demo Day之前,VR陀螺记者也特地与公司的两位创始人RH和Brian深入了解了背后的技术,以及亲身体验了一把随时“变身”卡通人物的经历。

成本不到2万块!用AI识别你的声音

对于大多数人来说,“全身动捕”听上去是一项非常遥远和高大上的技术。实际上,这项本来用于影视行业的技术在近年来已经逐渐在泛娱乐产业得到应用,比如最近大火的“虚拟主播”就大都采用了全身动捕,而非真的使用人工智能。

在Vive Tracker推出之时,其能够以低成本方式实现动作捕捉的能力也获得了不少关注。Red Pill Labs正是利用了Tracker的这一特性实现了对用户身体的捕捉,同时再通过AI进行面部表情的深度学习计算,从而在虚拟形象身上实时呈现出真人表演者的动作。

但Red Pill最特殊的一点在于,和其他通过摄像头捕捉面部表情的方案不同,他们选择捕捉用户的声音。

“我们认为声音是被很多人忽视的,”RH说。

据他介绍,公司的这套系统在通过麦克风捕捉到用户的声音之后,借由AI对声音数据进行实时的分析,然后同步在虚拟形象脸部生成表情。这里的表情包含两部分,一个是实时的嘴形,其他部分则通过眉毛的运动来表现。

这样的描述不禁让我想到了Animoji。当然苹果采用了TOF方案,也就是通过“刘海”那处的一系列深度摄像头来实现实时的面部捕捉。但是Red Pill的声音方案真的靠谱吗?

从记者的体验来看,声音转化成面部表情的效果居然出人意料的不错。从视频中我们可以看到,动画人物嘴部的动作基本上和表演者的声音没有延时,同时也非机械的一张一合,而是随着声音的变化在幅度上不一样。同时,动画人物的眉毛也会在发声的过程中一起运动,包括眼睛的大小也会有小幅度的变化,这些元素交织在一起呈现出虚拟人物表情的变化。

据Brian介绍,目前世界上正在研发这类技术的仅有Red Pill、英伟达和迪士尼。英伟达技术的限制在于,需要锁定同一个表演者的声纹和虚拟角色;迪士尼则需要先将要讲的东西变成文字,再让机器处理成虚拟人物脸上的实时表情。

除了面部表情,Red Pill通过Tracker+Lighthouse对表演者身体动作的捕捉也已经做到非常自然。在体验的20分钟过程中,动捕没有出现卡顿现象,蹲下、坐下、转身和小跑时的追踪也没有问题,肩膀和手腕也可以转动。由于公司的这套软件基于Unity的架构开发,因此也可以通过手柄上的按键实时切换虚拟表演的背景图片(视频),以及为虚拟角色设计武器、交互等。公司甚至还自行开发了一款手套,可以更为精细的模拟出手指的动作。

Brian还谈到,目前这套方案最多可以让两位表演者同时进习动捕的表演。但随着新一代Lightohuse的推出,接下来将会实现4个人在10*10平方米的空间内同时表演。

而实现这些效果的前提——用户需要花费的成本相当低。对于有Vive的用户,只需另外购买4个Tracker,以美元计算为400刀;对于没有Vive的用户来说,目前购入一套Vive仅需500刀,也就是硬件成本在900刀左右。

从VR社交转向教育和直播

实际上,我和Red Pill Labs的CTO,也是创始人之一的Dobry早在去年7月的RISE香港展会上就有过交流。但是在9个月之前,公司还希望将这套系统用在VR社交平台上,AI技术可以通过对大数据的分析和深度学习来对Avatar的动作进行预测,数据越多,Avatar呈现出来的动作就会越自然和符合逻辑。

1 2 下一页>