华人科学家一人斩获三篇CVPR论文!技术成果或将产品化

阿里巴巴近日美国夏威夷刮起了“阿里旋风”。继淘宝的“拍立淘”让外国工程师大呼好用之后,又传来阿里巴巴人工智能实验室共有三篇论文入选 CVPR 2017 的好消息。

CVPR被誉为科技界中的“春晚”,是近十年来计算机视觉领域全球最有影响力、内容最全面的顶级学术会议,由全球最大的非营利性专业技术学会IEEE(电气和电子工程师协会)主办。2017谷歌学术指标(Google Scholar)按论文引用率排名, CVPR位列计算机视觉领域榜首。据CVPR评委会披露,今年CVPR审核了2620篇文章,最终收录783篇,录取率为29%。

阿里巴巴人工智能实验室此次入选的三篇论文均有杰出科学家王刚的深度参与,分别针对深度学习和计算机视觉所涉及的上下文模拟、场景分割、行为理解等问题提出了解决办法。 王刚向记者表示,“这三篇论文都来自于深度学习中的应用场景,未来或将通过人工智能实验室进行落地,例如运用到家庭安全监测场景中”。

王刚于2017年3月加入阿里巴巴人工智能实验室,担任杰出科学家,负责机器学习、计算机视觉和自然语言理解的研发工作。他此前曾是南洋理工大学的终身教授,同时也是人工智能领域最顶尖杂志IEEE Transactions on Pattern Analysis and Machine Intelligence的编委 (Associate Editor),曾多次受邀成为人工智能顶级学术会议如International Conference on Computer Vision的领域主席,在深度学习算法领域具有深厚的研究积累和国际权威。2016年,他还因在深度神经网络设计上的卓越贡献,成为当年《麻省理工技术评论杂志》评选出的10名亚洲区35岁以下青年创新奖得主之一。

以下是对三篇论文的解读

1.Deep Level Sets for Salient Object Detection

结合深度网络的水平集方法在显著性目标检测中的应用

简介:

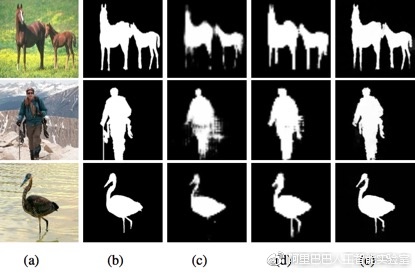

如图,a是输入图像,b是对应saliency区域的ground truth,c、d对应使用BCE loss训练的深度网络和使用水平集方法的效果,e对应论文的方法;可以看到e在分割细节方面和ground truth最为接近,效果更好,在细节方面提升明显。

显著性目标检测能够帮助计算机发现图片中最吸引人注意的区域,有效的图像分割和图像的语意属性对显著性目标检测非常重要。由南洋理工大学和阿里巴巴人工智能实验室合作,共同提出了一种结合深度网络的水平集方法,将分割信息和语意信息进行结合,获得了很好的效果。水平集方法是处理封闭运动界面随时间演化过程中几何拓扑变化的有效的计算工具,后来被用到图像分割算法当中。深度学习能够很好的建模显著性目标的语意属性,进而进行显著性目标检测,但更多的语意属性信息导致分割边界的低层信息不准确。论文巧妙的结合了深度网络和水平集方法(Deep Level Sets),同时利用图片低层的边界信息以及高层的语意信息,在显著性目标检测领域获得了state-of-art的效果。

2.Global Context-Aware Attention LSTM Networks for 3D Action Recognition

将全局上下文注意力机制引入长短时记忆网络的3D动作识别

简介:

如图,3D动作识别能够帮助计算及更好的理解人体动作(最左侧的文字),未来可以作为人机交互的一种补充。

3D动作识别能够帮助计算机更好的分析人的动作以及为多样化的人机交互提供更多的选择。一个好的3D动作识别系统需要很好的处理动作在时间(动作需要一定时延)、空间(结构)上的信息。LSTM(长短时记忆网络)能够很好的建模动态的、相互依赖的时间序列数据(如人的3D动作序列),注意力机制能够更有效的获取数据中的结构信息,并排除掉噪声的干扰。由南洋理工大学、北京大学、阿里巴巴人工智能实验室合作,论文结合LSTM和上下文注意力机制,提出了一种新的LSTM网络:GCA-LSTM(Global Context-Aware Attention LSTM);用来建模动作序列中有效的全局上下文信息(时间信息+空间信息),进而进行3D动作识别。同时,论文为GCA-LSTM网络提出了一种循环注意力机制来迭代提升注意力模型的效果。论文方法在3个主流的3D动作识别数据集上都达到了state-of-art的效果。

3.Episodic CAMN: Contextual Attention-based Memory Networks With Iterative Feedback For Scene Labeling

引入迭代反馈的上下文注意力机制记忆网络在场景分割中的应用

简介:

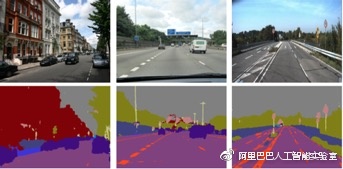

如图,这是场景分隔在自动驾驶中的应用,通过对路面场景进行分割,可以帮助无人车分析那部分区域是可行驶区域(如图粉红色部分)。

场景分割有着广阔的应用前景,比如自动驾驶汽车通过场景分割获取可行驶区域,比如室内机器人通过场景分割获知室内物体的分布。场景分割对待分割区域周围的区域以及全局信息有较强的依赖关系,但这种依赖关系是动态变化的(即使同一区域在不同的场景中对周围信息的依赖是不同的),因此动态的获知不同区域的依赖关系以及图像全局上下文特征的使用至关重要。由南洋理工大学,伊利诺伊大学厄巴纳-香槟分校,阿里巴巴人工智能实验室合作,论文通过一个可学习的注意力机制网络来刻画不同区域之间的依赖关系,并获取包含上下文信息的特征。进一步,论文通过引入迭代反馈的方式对注意力机制网络的输出进行调节,以获得更好的包含上下文的特征。上述方法在场景分隔任务中获得了和当前state-of-art算法相当的效果。